Temel Noktalar

Doğrulanabilir Yapay Zekâ, AI çıktılarının, model davranışlarının veya içerik kökeninin yalnızca iddialarla değil, kanıtlarla desteklenmesi gerektiği fikridir.

Uygulamada Doğrulanabilir AI; içerik kökeni, filigranlama, kriptografik imzalar, Güvenilir Yürütme Ortamları (TEE'ler) ve çıkarım için sıfır bilgi kanıtı veya diğer kanıt sistemlerini içerebilir.

Kripto alanında bu kavram özellikle önemlidir; çünkü akıllı sözleşmeler opak ve zincir dışı AI çıktılarında güveni minimize eden bir doğrulama katmanı olmadan güvenle işlem yapamaz.

Nisan 2026 itibarıyla Chainlink, Lagrange ve 0G gibi projelerin yanı sıra C2PA Content Credentials ve SynthID gibi medya filigranlama araçlarını kapsayan altyapı standartları gündemdedir.

Doğrulanabilir AI umut vadediyor, ancak henüz erken bir aşamadadır. Evrensel bir standart bulunmamaktadır ve farklı sistemler farklı unsurları doğrulamaktadır.

Yapay zekâ giderek daha güçlü hale geliyor, ancak ona güvenmek de bir o kadar zorlaşıyor.

Bir AI modeli bir raporu özetlediğinde, bir işlemi işaretlediğinde, bir varlığın fiyatını belirlediğinde, zincir üstü bir olayı tetiklediğinde veya bir görsel oluşturduğunda; kullanıcılar genellikle sistemin iddia ettiği işi gerçekten yaptığına güvenmek zorunda kalıyor. Pek çok durumda, hangi modelin çıktıyı ürettiğini, hangi verileri kullandığını, çıktının değişip değişmediğini veya modelin onaylı bir ortamda çalışıp çalışmadığını bağımsız olarak doğrulayamazlar. Bu güven boşluğunu kapatmak için Doğrulanabilir AI geliştirilmektedir. OpenAI, AI'da doğrulanabilirliği; AI sistemleri hakkındaki iddialara kanıt sunabilme kapasitesi olarak tanımlarken, NIST ise içerik kökeni ve güvenilir AI sistemleri için filigranlama, kriptografik imzalar, dijital parmak izleri ve model bütünlüğü doğrulama tekniklerini vurgulamaktadır.

Doğrulanabilir AI, AI sistemlerini daha denetlenebilir, kanıtlanabilir ve müdahale edildiğinde anlaşılabilir kılan yöntemler bütününü ifade eder. Kullanıma göre, AI ile üretilen bir içeriğin kökeninin kanıtlanması, belirli bir modelin iddia edildiği gibi çalıştığının kanıtlanması, giriş ve çıktının değişmediğinin kanıtlanması veya zincir dışı AI hesaplamasının zincir üstü bir uygulama tarafından güvenle kullanılabileceğinin kanıtlanması anlamına gelebilir. Chainlink'in yakın tarihli "doğrulanabilir AI katmanı" açıklaması bunu şu şekilde özetler: AI'yı kriptografik kanıtlar ve blockchain altyapısıyla birleştirerek, akıllı sözleşmelerin zincir dışı AI çıktısını bütünlük garantileriyle kullanmasını sağlar.

Başka bir deyişle, Doğrulanabilir AI tek bir ürün veya token değildir. Daha geniş bir tasarım yaklaşımıdır: Kullanıcılardan bir AI sistemine sadece güvenmelerini istemek yerine, onlara kanıt sunun.

"Doğrulanabilir AI" Ne Anlama Geliyor?

Bu kavram soyut gelebilir; aşağıdaki soruyla basitleştirilebilir:

Tam olarak neyi doğruluyoruz?

Bu aşağıdakileri kapsayabilir:

Kökenin doğrulanması — Bu görsel, video, ses klibi veya belge AI tarafından mı üretildi/düzenlendi, kökeni nedir? C2PA'nın Content Credentials standardı bu fikre dayanır; içerik kökenini kanıtlamak ve içerik nasıl oluşmuş veya değiştirilmişse buna dair beyanları güvenli şekilde bağlamak için geliştirilmiştir.

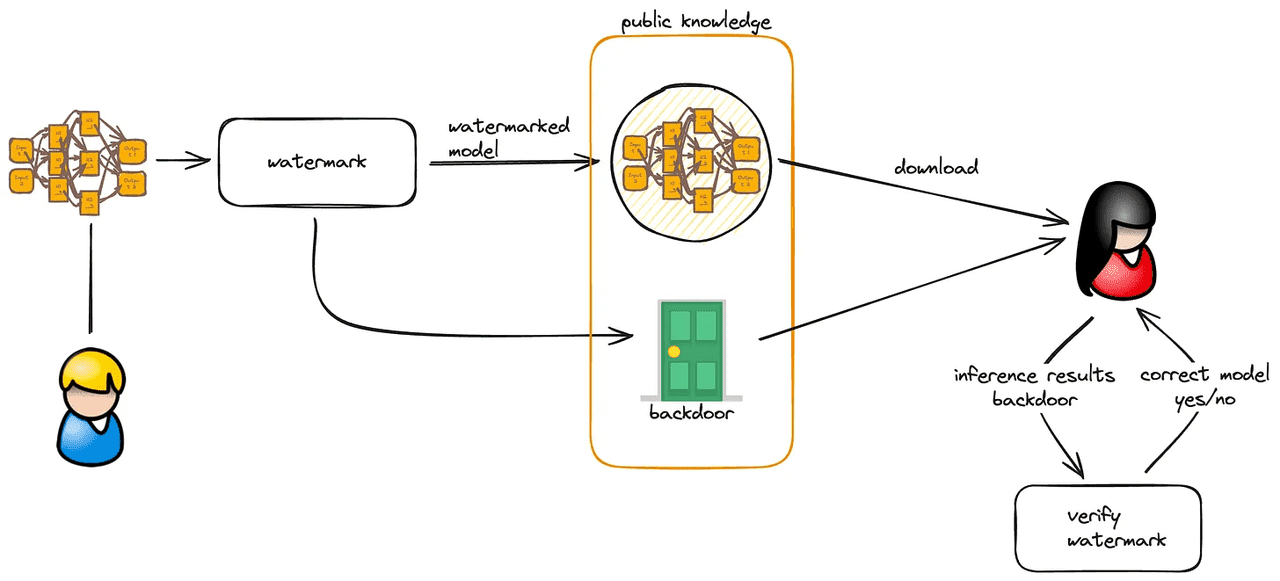

Üretimin doğrulanması — Bu içerik onaylı bir AI sistemi tarafından mı üretildi? Google DeepMind’in SynthID’si, AI ile üretilen veya değiştirilmiş içeriği tespit etmeye dönük bir filigranlama örneğidir.

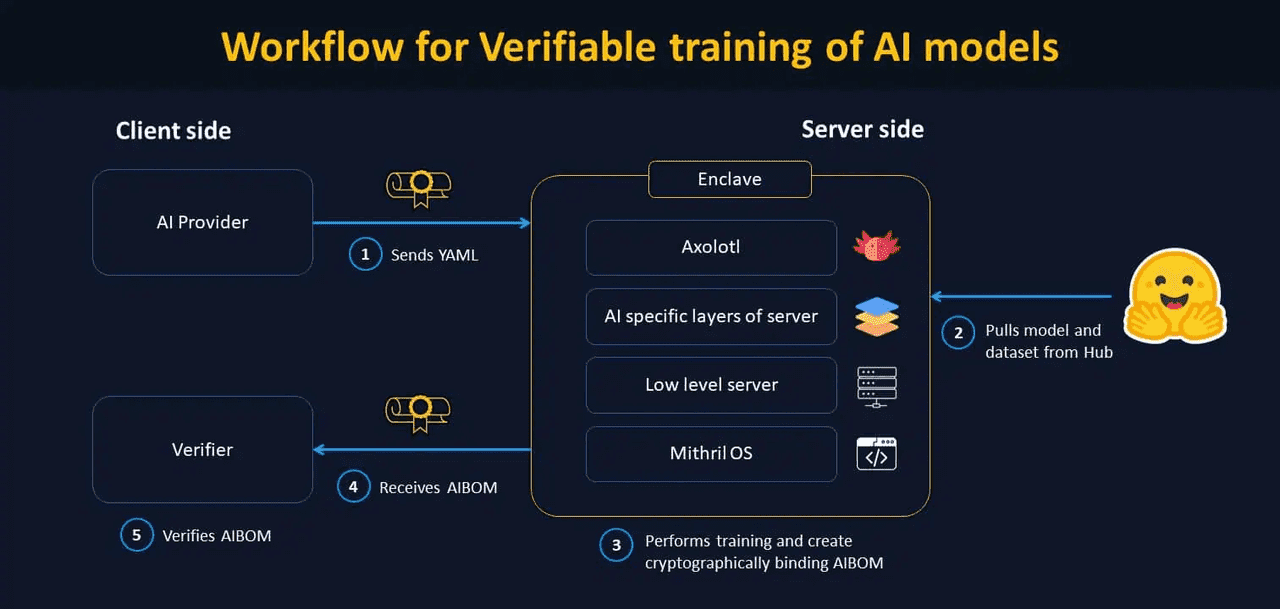

Yürütmenin doğrulanması — AI modeli, iddia edildiği gibi, amaçlanan verilerle, amaçlanan ortamda, müdahale olmadan mı çalıştı? Burada TEE’ler, attestation sistemleri ve kanıta dayalı çıkarım sistemleri devreye girer. Chainlink’in eğitim materyalleri ve yakın tarihli Doğrulanabilir AI yazısı, bu sorunu güvenli model çalıştırma ve doğrulanabilir hesaplama ile ilişkilendirir.

Blockchain için hesaplama doğrulaması — Bir akıllı sözleşme, model zincir dışında çalıştıysa, AI çıktısına güvenle işlem yapabilir mi? Blockchainler doğrudan zincir dışı çıkarımı inceleyemez; bu nedenle, AI’nın zincir üstü yüksek değerli eylemleri tetikleyebilmesi için doğrulanabilir hesaplama ve kanıt katmanları gerekli hale gelmektedir.

Birisi "Doğrulanabilir AI" dediğinde, bunlardan bir veya birkaçını aynı anda kastetmiş olabilir. Bu nedenle kategori geniştir: Bir ekip medya kimlik doğrulamaya, diğeri çıkarım doğruluğunu kanıtlamaya, bir diğeri ise AI ajanlarını, zincir üstü iş akışlarında denetlenebilir hale getirmeye odaklanabilir.

Neden Doğrulanabilir AI Önemli?

AI, insanların manuel olarak her şeyi inceleyemediği yerlerde devreye girebildiği için faydalıdır. Fakat bu bir sorun doğurur: Çıktı önemliyse, doğrulama ihtiyacı artar.

Şu örnekleri düşünün:

- Bir AI modeli, düzenlenen bir finansal platformda şüpheli işlemleri işaretliyor.

- Bir AI oracle, olay analizini tahmin piyasasına aktarıyor.

- Otonom bir AI ajanı zincir üstü bir portföyü yeniden dengeliyor.

- Oluşturulan bir görsel veya video, piyasa hareketlendiren bir haber sırasında viral oluyor.

- Bir işletme, bir modelin belirli veri kullanımı veya uyum kısıtlarına uyduğunu kanıtlamak istiyor.

Tüm bu durumlarda güven, sadece "model öyle dedi"ye dayanamaz. NIST’in sentetik içerik risk azaltma rehberinde köken doğrulama ve filigranlama gibi araçların kullanılmasının önemi vurgulanırken, OpenAI AI geliştirme sürecinde doğrulanabilirliği; sistemlerin güvenli, adil veya gizliliği koruyucu olduklarına dair kanıt sunmak olarak ele alır.

Kripto bu sorunu daha da keskinleştirir. Blockchainler güveni minimize etmek için tasarlanmıştır; oysa AI sistemleri genellikle opak, zincir dışı ve denetlenmesi zordur. Bu doğal bir uyumsuzluktur. Chainlink’in yakın tarihli materyalleri bu noktaya doğrudan değinir: Zincir dışı veri işleme ve model tabanlı iş akışlarının şeffaf, denetlenebilir ve politika uyumlu biçimde zincir üstüne raporlanabilmesi için doğrulanabilir AI ve AI ajan orkestrasyonu gereklidir.

Bu nedenle Doğrulanabilir AI, AI x kripto başlığında öne çıkan alt anlatılardan biri olmaktadır. Zeki sistemlerle güven-minimize sistemler arasındaki boşluğu kapatmaya çalışır.

Yapay Zekâ Eğitimi için Doğrulanabilir İş Akışı (kaynak)

Doğrulanabilir AI'nın Temel Bileşenleri

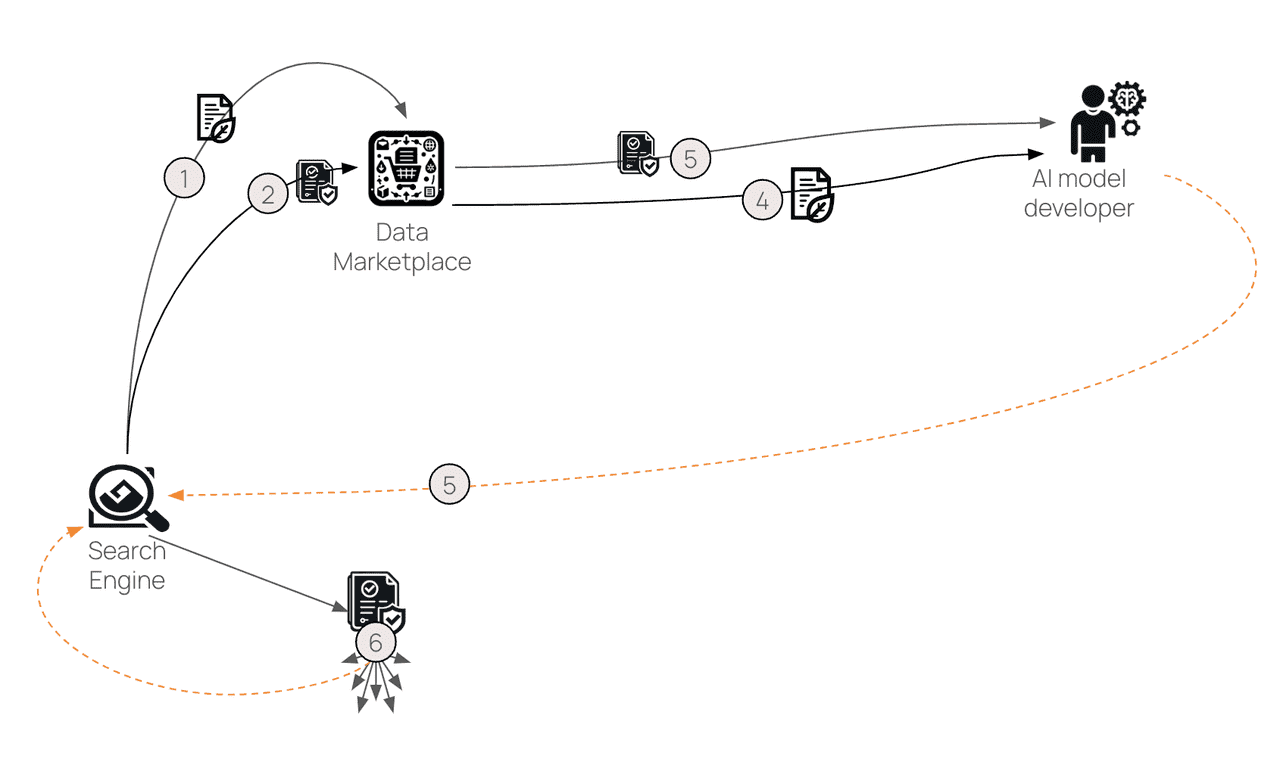

Köken ve İçerik Bilgileri

Doğrulanabilir AI'nın en basit biçimlerinden biri, içeriğin nereden geldiğini kanıtlamaktır.

C2PA çerçevesi bu alandaki başlıca standartlardan biridir. İçerik Bilgileri, içeriğin kökenini kanıtlamak ve köken beyanlarını medya ile güvenli şekilde birleştirmek için bir yol sağlar. Grup, İçerik Bilgileri’ni dijital içerik için bir tür “besin etiketi” gibi tanımlar; bu sayede kullanıcılar, içeriğin geçmişini inceleyebilir.

Bu yaklaşım, kullanıcılara içeriğin "doğru" olup olmadığını doğrudan göstermez; fakat şu soruları yanıtlamaya yardımcı olur:

- Kim oluşturdu?

- AI kullanıldı mı?

- Düzenlendi mi?

- Hangi yazılım kullanıldı?

- Köken verisi korundu mu?

Bu, gazetecilikte, markalar için, yasal kanıtlarda ve sahte veya manipüle medya gerçek zarara yol açabileceği her ortamda önem taşır. Kripto için de önemlidir; çünkü sahte ekran görüntüleri, belgeler ve AI üretimi yanlış bilgiler piyasayı hızla etkileyebilir.

Filigranlama

Bir diğer katman, AI ile üretilen medyaya daha sonra tanımlanabilmesi için işaretler gömmektir.

Google DeepMind’in SynthID’si bu yaklaşımın en açık örneklerindendir. DeepMind bunu, üretken AI’da şeffaflık ve güven oluşturmak için tasarlanmış, AI ile üretilen içeriğe filigran ekleme ve tanımlama aracı olarak tanımlar. Görsellerde bu sistem, algılanamaz bir filigranı doğrudan piksellere yerleştirir; ayrıca DeepMind, oluşturulan müzik ve ses için ses filigranlama yaklaşımlarını da açıklamıştır.

Filigranlama faydalıdır, ancak tek başına yeterli değildir. NIST’in sentetik içerik rehberinde, köken ve filigranlamanın kimlik doğrulamada yardımcı olduğu, ancak güvenilirlik, sağlamlık ve kaldırma/bozuma direnç açısından değerlendirilmesi gerektiği belirtilir.

Bu nedenle filigranlama, Doğrulanabilir AI'nın bir parçası olarak düşünülmelidir; tek çözüm değildir.

Güvenilir Yürütme Ortamları (TEE’ler)

Bir diğer yaklaşım ise modelin nerede ve nasıl çalıştığını doğrulamaktır.

TEE’ler, bir hesaplamanın korumalı bir sistemde gerçekleştiğini kanıtlamaya yardımcı olan donanım tabanlı izole ortamlardır. Chainlink'in blockchain'de TEE'ler hakkındaki açıklaması, bu teknolojinin özellikle AI için önemli olduğunu belirtir; zira model ağırlıkları ve giriş verileri gizli veya özel olabilir ve TEE'ler, gizliliği korurken doğrulanabilir AI için güvenli ortamlar sağlar.

Bu, merkeziyetsiz hesaplama ağlarında çok önemlidir. Geliştiriciler çıkarımı üçüncü taraf makinelere yaptırıyorsa, makinenin doğru modeli çalıştırdığından, veriyi sızdırmadığından ve çıktıyı uydurmadığından emin olmalıdırlar. TEE'ler bu konuda bir çözüm sunar—her ne kadar mükemmel olmasa da—çünkü çalışma ortamı hakkında doğrulama sağlarlar.

Çıkarım için Kriptografik Kanıtlar

Daha güçlü ama uygulanması daha zor olan bir yaklaşım ise AI hesaplamasının kendisini kanıtlamaktır.

Burada sıfır bilgi makine öğrenimi, doğrulanabilir çıkarım ve kanıta dayalı sistemler devreye girer. 2025 tarihli bir ZKP tabanlı doğrulanabilir makine öğrenimi araştırması, eğitim, çıkarım ya da testin hassas verileri açıklamadan doğrulanmasını amaçlayan geniş bir araştırma alanını anlatır. Mart 2026’da yayınlanan bir makale ise büyük modeller için geleneksel kanıt sistemlerinin getirdiği ağır yükü azaltmayı amaçlayan hafif kriptografik çıkarım kanıtları önermektedir.

Bu önemlidir; çünkü Doğrulanabilir AI’nın ideal noktası sadece "bu güvenli kutuya güvenin" değil, "hesaplamanın doğru şekilde yapıldığına dair kriptografik kanıt burada"dır. Uygulamada, büyük modeller için bu hâlâ zorlayıcıdır zira kanıtlar hesaplama açısından maliyetlidir. Fakat araştırma yönü açıktır: AI çıkarımını kanıtlanabilir kılarken kullanılmaz derecede yavaşlatmamak.

Kullanım Senaryosu Örneği (kaynak)

Kriptoda Doğrulanabilir AI Ne Anlama Geliyor?

Geleneksel yazılımda güven, genellikle itibar, sözleşmeler veya merkezi denetimden gelir. Kriptoda ise çıta başkadır: Kullanıcılar, sistemlerin açık, birleştirilebilir ve bağımsız olarak denetlenebilir olmasını bekler.

Bu bir gerilim yaratır. AI, alım-satım, otomasyon, uyum ve öngörü için giderek daha fazla kullanışlı hale geliyor; ancak kara kutu bir model çıktısı, güven-minimize altyapı ile kolayca uyumlanamaz. Chainlink’in yakın tarihli makaleleri, tam da burada merkeziyetsiz oracle ağlarının, uzlaşıya dayalı raporlamanın ve doğrulanabilir hesaplamanın rol oynayabileceğini savunur. Girdiler merkeziyetsiz altyapı üzerinde getirilip işlenebilir, ardından hiçbir tekil operatöre bağlı kalmadan zincir üstüne raporlanabilir.

Bu özellikle şu alanlarda öne çıkıyor:

- Tahmin piyasaları, sigorta veya olay tabanlı protokoller için AI oracles

- Güvenilir veri ve denetlenebilir eylemler gerektiren otonom alım-satım ajanları

- Kurumların politika uygulamasını kanıtlaması gereken uyum iş akışları

- AI’dan faydalanmak isteyen, ama güveni tamamen merkezileştirmek istemeyen zincir üstü tüketici uygulamaları

Kısacası, Doğrulanabilir AI, "blockchain üzerinde AI"yı bir pazarlama ifadesinden fazlasına dönüştüren şeydir.

Piyasadaki Doğrulanabilir AI Anlatılarına Örnekler

Chainlink: Doğrulanabilir AI Katmanı

Chainlink, Doğrulanabilir AI'yı AI, kriptografik kanıtlar ve blockchain altyapısını birleştiren bir katman olarak tanımlayan net kaynaklardan biridir. Son materyallerinde bu konsept akıllı sözleşmeler, TEE’ler, ajan orkestrasyonu, kurumsal sözleşmeler ve doğrulanabilir zincir dışı hesaplama ile ilişkilendirilmektedir.

Akademi okurları için önemli nokta, sadece "Chainlink AI yapıyor" değil, AI çıktılarının zincir üstünde kullanılacak kadar güvenilir hale gelmesi için bir çerçevenin tarif edilmesidir.

Lagrange: ZK Destekli Doğrulanabilir AI

Lagrange resmi belgelerinde projeyi doğrulanabilir teknoloji odağında konumlandırır ve DeepProve ürününden "doğrulanabilir AI" çözümü olarak bahseder. Proje, "AI'nın geleceği ZK'dır" diyerek, sıfır bilgi kanıt sistemlerinin güvenilir AI hesaplaması için temel altyapı olacağına inandığını gösterir.

0G: Merkeziyetsiz AI Altyapısı

0G dokümantasyonu sadece doğrulanabilirlikle sınırlı değildir; ancak ekosistem pozisyonu, merkeziyetsiz çıkarım, depolama ve veri erişilebilirliği gibi merkeziyetsiz AI altyapısı ile yakından bağlantılıdır. Ekosistemle ilgili kamuya açık materyallerde 0G, "doğrulanabilir AI"yı altyapı anlatısının bir parçası olarak vurgulamaktadır. Belgelerinde, geliştiricilerin çıkarım servislerine nasıl erişebileceğini ve ağın veri erişilebilirliği ile doğrulamayı özel düğümlerle nasıl sağladığını göstermektedir.

Bu örnekler, Doğrulanabilir AI'nın yalnızca akademik bir terim olmadığını, kripto piyasasında canlı ürün ve altyapı anlatılarına dönüştüğünü gösterir.

Pratikte Doğrulanabilir AI Nasıl Çalışabilir?

Doğrulanabilir AI'yı değerlendirmek için faydalı bir yol; onu bir kanıt zinciri olarak düşünmektir.

Örneğin, zincir üstü AI destekli bir sigorta ürünü hayal edin:

- Kullanıcı, görsel ve belgelerle bir talep gönderir.

- Model, talebi zincir dışında analiz eder.

- Sistem, gönderilen ve üretilen medya için köken kaydeder.

- Model, TEE veya başka doğrulanmış bir ortamda çalışır.

- Merkeziyetsiz ağ, girdileri doğrular veya model çıktısını toplar.

- Sonuç imzalanır, kaydedilir ve zincir üstüne raporlanır.

- Akıllı sözleşme, gerekli kanıt kontrolleri geçilirse harekete geçer.

Farklı sistemler bu yığının farklı bölümlerini uygulayacaktır, fakat temel fikir aynıdır: Her kritik adımı daha şeffaf ve taklit edilmesi zor hale getirmek. Chainlink’in kurumsal akıllı sözleşmeler ve AI orkestrasyonu üzerine yakın tarihli materyalleri, bu tür bir mimariyle doğrudan örtüşürken, C2PA ve filigran sistemleri medya ve köken tarafını ele alır.

Doğrulanabilir AI'da Verinin Rolü (kaynak)

Doğrulanabilir AI'nın Faydaları

En büyük fayda açıktır: Daha fazla güven. Ancak bu güven birkaç somut kazanca bölünebilir.

Birinci olarak, Doğrulanabilir AI denetlenebilirliği artırabilir. Kullanıcılardan bir model sağlayıcısının iddiasına inanmalarını istemek yerine, sistemler kimlik bilgileri, imzalar, attestation'lar veya kanıtlar gibi unsurlar sunabilir.

İkinci olarak, uyum hazırlığını iyileştirir. Chainlink’in yakın tarihli uyum için AI ve kurumsal akıllı sözleşmeler materyallerinde gösterildiği gibi; düzenlenmiş finans bu konuya neden önem verir: Politika uygulaması, raporlama ve denetim izleri, altyapı ne olduğunu kanıtlayacak şekilde tasarlanırsa kolaylaşır.

Üçüncü olarak, manipülasyona karşı dayanıklılığı artırır. Köken sistemleri ve filigranlama tüm deepfake’leri veya yanlış bilgileri durduramaz; ama müdahaleyi tespit edilebilir ve özgünlük sinyallerini güçlü kılar.

Dördüncü olarak, Web3 için birleştirilebilirliği iyileştirir. Akıllı sözleşmeler, ajanlar ve protokoller; çıktıya ekli kanıtları inceleyebildiğinde AI’yı daha güvenli kullanabilir.

Sınırlamalar ve Riskler

Doğrulanabilir AI umut vadedici, ancak sihirli bir çözüm değildir.

En önemli sınırlama, farklı yöntemlerin farklı unsurları doğrulamasıdır. Bir filigran, medyanın AI ile üretildiğini gösterebilir, ancak içeriğin iddiasının doğruluğunu kanıtlamaz. Bir köken kaydı, düzenleme geçmişini gösterebilir, ancak içeriğin doğruluğunu garanti etmez. Bir TEE, çalışma ortamını doğrulayabilir, ancak kullanıcıların önemsediği tüm özellikleri kapsamayabilir. Çıkarım kanıt sistemleri ise birçok büyük model için hâlâ kaynak açısından yoğundur.

Bir diğer zorluk, standartlarda parçalanmadır. C2PA köken için önemlidir, ancak AI yürütmesi için evrensel bir çözüm değildir. ZK sistemler gelişiyor, ancak hâlâ tüm AI uygulamaları için evrensel bir çalışma katmanı değildir. TEE’ler pratik olsa da donanım ve doğrulama konusunda yeni güven varsayımları getirir.

Ayrıca maliyet ve performans arasında denge gerektirir. Daha güçlü doğrulama genellikle daha fazla ek yük getirir. Bu nedenle güncel araştırmalar, tüm çıkarımların ucuz şekilde tamamen kanıtlanacağı varsayımı yerine daha hafif kanıt sistemleri ve hibrit yaklaşımlar üzerinde çalışır. Son olarak, kriptoda pazarlama riski vardır: Projeler, doğrulama garantileri dar olsa bile "Doğrulanabilir AI" anlatısı kullanabilir.

Sonuç

Doğrulanabilir AI, modern AI sistemlerinin temel zayıflığı olan opaklığı ele aldığı için AI ve kriptonun birleşiminden doğan en önemli fikirlerden biridir.

AI; finans uygulamaları, zincir üstü ajanlar, medya sistemleri, uyum iş akışları ve otonom yazılımlara daha derinlemesine entegre oldukça, kullanıcılar yalnızca model çıktısından fazlasına ihtiyaç duyacaktır. Kanıtlar, köken, attestation’lar ve denetim izleri gerekecektir. İşte Doğrulanabilir AI'nın gerçek vaadi budur.

Kategori Nisan 2026 itibarıyla hâlâ erken aşamadadır ve henüz evrensel bir mimarisi yoktur. Bunun yerine bir yığın olarak gelişmektedir: C2PA gibi köken standartları, SynthID gibi filigranlama araçları, TEE gibi güvenli çalışma yöntemleri ve çıkarım veya zincir üstü raporlama için daha gelişmiş kanıt sistemleri. Chainlink, Lagrange ve 0G gibi projeler bu yığının farklı bölümlerini ilerletmektedir.

Bu yaklaşımı en basit şekilde şöyle özetleyebiliriz: Doğrulanabilir AI, AI'yı sadece kullandığınız bir şey olmaktan çıkarıp, kanıtlarla inceleyip güvenebileceğiniz bir şeye dönüştürmektir. Bu değişim devam ederse, AI destekli kripto uygulamalarının bir sonraki neslinin temel fikirlerinden biri haline gelebilir.

AI ve blockchain birlikte geliştikçe, Doğrulanabilir AI gibi anlatılar hem yatırımcılar hem de geliştiriciler için giderek daha önemli hale gelebilir. AI ajanları, DePIN, RWA ve zincir üstü altyapı gibi gelişen kripto sektörlerini takip etmek isteyen kullanıcılar için Phemex, piyasa trendlerini izleyebileceğiniz, yeni fırsatları keşfedebileceğiniz ve alım-satım avantajınızı geliştirebileceğiniz güvenli ve kullanıcı dostu bir platform sunar.