Points clés

L'IA vérifiable prône que les résultats de l'IA, le comportement des modèles ou la provenance du contenu doivent être accompagnés de preuves concrètes, et non de simples affirmations.

En pratique, cela inclut la provenance des contenus, le filigranage, les signatures cryptographiques, les environnements d'exécution sécurisés (TEE) et les systèmes de preuve (comme la preuve à connaissance nulle) pour l'inférence IA.

Le concept est crucial dans la crypto, car les contrats intelligents ne peuvent pas se fier aveuglément aux résultats opaques d'IA hors chaîne sans une couche de vérification minimisant la confiance.

Au 04/2026, le secteur voit émerger des solutions d'infrastructure portées par des projets tels que Chainlink, Lagrange et 0G, ainsi que des standards de provenance comme C2PA et des outils de filigrane média comme SynthID.

L'IA vérifiable est prometteuse, mais encore jeune. Aucune norme universelle n'existe encore, et chaque système vérifie des aspects différents.

L'intelligence artificielle devient plus puissante, mais il devient aussi plus difficile de lui accorder une confiance absolue.

Lorsque l'IA résume un rapport, signale une transaction, évalue un actif, déclenche une action on-chain ou génère une image, les utilisateurs doivent généralement faire confiance à ce que le système déclare avoir fait. Souvent, ils ne peuvent pas vérifier eux-mêmes quel modèle a produit le résultat, quelles données ont été utilisées, si la sortie a été modifiée ou si le modèle a fonctionné dans un environnement approuvé. Cet écart de confiance est précisément ce que l'IA vérifiable cherche à combler. OpenAI évoque la vérifiabilité comme la capacité à fournir des preuves des affirmations avancées par un système d'IA, tandis que le NIST insiste sur des techniques telles que le filigranage, les signatures cryptographiques, les empreintes digitales numériques et la vérification de l'intégrité des modèles pour renforcer la provenance des contenus et la fiabilité des systèmes IA.

De manière générale, l'IA vérifiable regroupe des méthodes permettant de rendre les systèmes IA plus audités, vérifiables et résistants à la falsification. Selon l'usage, cela peut signifier prouver la provenance d'un contenu généré par IA, certifier qu'un modèle spécifique a bien été exécuté, garantir que les entrées et sorties n'ont pas été altérées, ou encore prouver qu'un calcul IA hors chaîne peut être utilisé de façon fiable par une application on-chain. La récente définition du "verifiable AI stack" de Chainlink illustre bien cette approche : combiner l'IA, les preuves cryptographiques et l'infrastructure blockchain pour permettre aux contrats intelligents d'utiliser les résultats IA avec des garanties d'intégrité sur l'exécution hors chaîne.

En somme, l'IA vérifiable n'est pas un produit ou un jeton unique, mais une philosophie de conception : il ne s'agit plus de demander aux utilisateurs de faire confiance à un système IA, mais de leur fournir des preuves objectives.

Que signifie vraiment « IA vérifiable » ?

Le terme peut sembler abstrait, alors posons la bonne question :

Que cherche-t-on exactement à vérifier ?

Cela peut recouvrir plusieurs aspects :

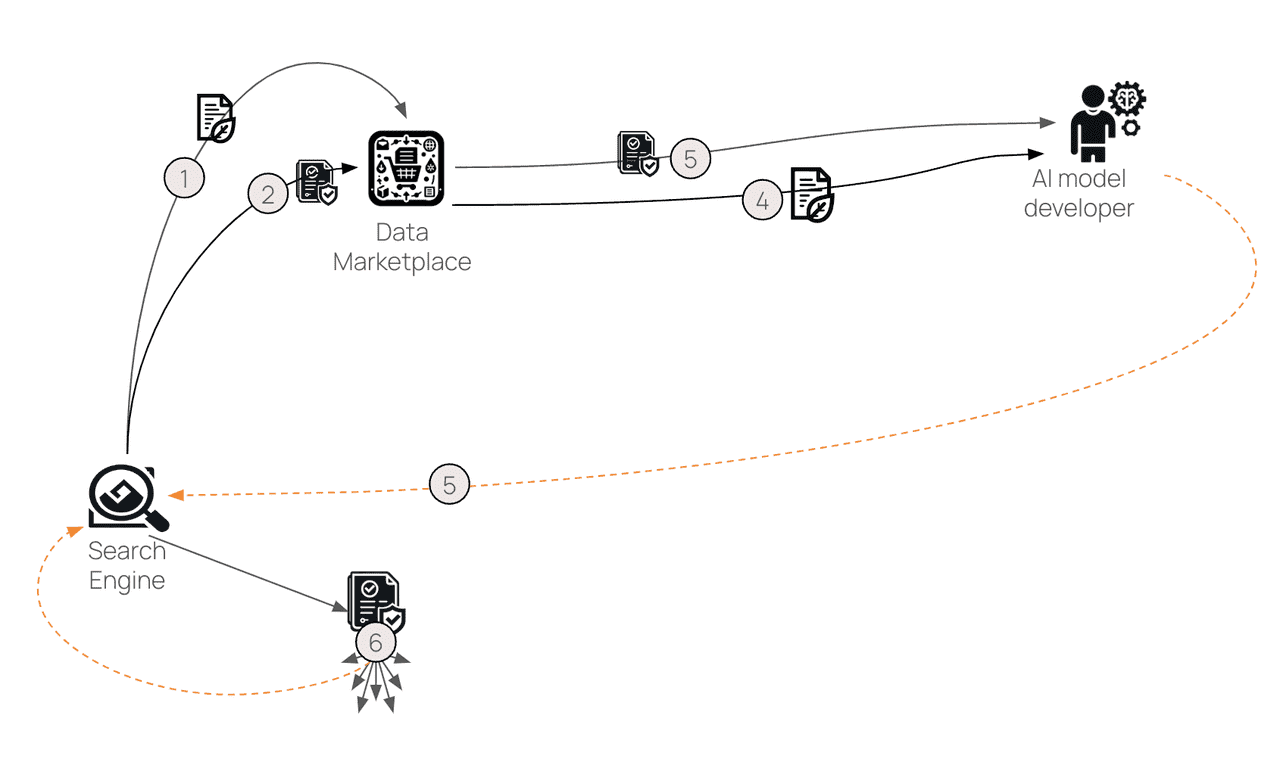

Vérifier la provenance — Cette image, vidéo, audio ou document a-t-il été créé ou modifié par l'IA, et quelle est son historique ? Le standard Content Credentials de C2PA s'articule autour de cette idée, en proposant un moyen d'établir la provenance du contenu numérique et de lier de manière sécurisée les informations relatives à sa création ou modification.

Vérifier la génération — Ce contenu a-t-il été produit par un système d'IA approuvé ? SynthID de Google DeepMind est un exemple de filigranage conçu pour identifier les contenus générés ou modifiés par l'IA.

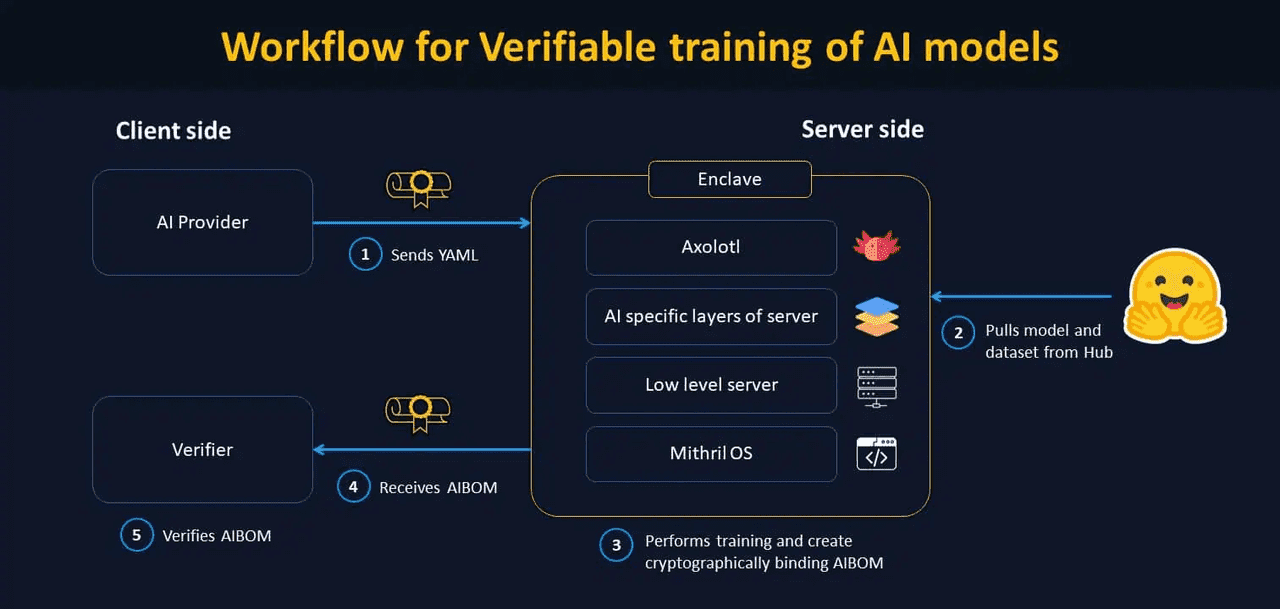

Vérifier l'exécution — Le modèle IA s'est-il exécuté comme annoncé, avec les entrées prévues, dans l'environnement prévu, sans intervention extérieure ? C'est là que les TEE, les systèmes d'attestation et les inférences à base de preuves entrent en jeu. Les supports éducatifs de Chainlink relient explicitement cette problématique à l'exécution sécurisée des modèles et à la computation de confiance.

Vérifier la computation pour la blockchain — Un contrat intelligent peut-il utiliser en toute sécurité un résultat IA exécuté hors chaîne ? Les blockchains ne pouvant inspecter directement une inférence opaque hors chaîne, la vérification computationnelle et les couches de preuve deviennent essentielles pour des actions on-chain à enjeux élevés.

Ainsi, lorsqu’on évoque « IA vérifiable », il peut s’agir d’un ou plusieurs de ces niveaux. La catégorie est donc large : une équipe peut se concentrer sur l’authentification des médias, une autre sur la vérification de l’inférence, une autre encore sur l’audit des agents IA dans des processus on-chain.

Pourquoi l'IA vérifiable est-elle importante ?

L'intérêt de l'IA est justement d'agir là où l'humain ne peut tout vérifier manuellement. Mais cela fait naître un besoin de vérification accru pour les résultats cruciaux.

Exemples :

Un modèle IA détecte des transactions suspectes sur une plateforme financière réglementée.

Un oracle IA fournit des analyses d'évènements à un marché de prédiction.

Un agent autonome rééquilibre un portefeuille on-chain.

Une image ou vidéo générée devient virale lors d'un événement impactant le marché.

Une entreprise souhaite prouver qu'un modèle respecte certaines contraintes réglementaires ou d'usage des données.

Dans tous ces cas, la confiance ne peut uniquement reposer sur « le modèle l’a dit ». Les recommandations du NIST sur la réduction des risques liés aux contenus synthétiques soulignent l’importance du filigranage et de l’authentification pour la provenance et l’intégrité, tandis qu’OpenAI présente la vérifiabilité comme un moyen d’apporter des preuves que les systèmes IA sont sûrs, équitables et respectueux de la vie privée.

La crypto accentue ce besoin. Les blockchains sont conçues pour minimiser la confiance, mais les IA sont souvent opaques, hors chaîne et difficiles à auditer. Il y a donc une inadéquation naturelle. Les documents récents de Chainlink insistent sur ce point : l’IA vérifiable et l’orchestration d’agents IA sont nécessaires pour que les processus de données hors chaîne et les workflows IA soient rapportés on-chain avec transparence, auditabilité et conformité.

C’est pourquoi l’IA vérifiable devient une des tendances majeures à l’intersection IA et crypto : elle veut combler le fossé entre systèmes intelligents et infrastructures minimisant la confiance.

Flux de travail vérifiable pour l’entraînement IA (source)

Les principaux piliers de l'IA vérifiable

Provenance et Content Credentials

L’une des formes les plus simples d’IA vérifiable consiste à prouver l’origine d’un contenu.

Le cadre C2PA fait figure de référence. Selon leurs explications, Content Credentials permet d’établir la provenance du contenu et d’y associer des déclarations sécurisées. Le site décrit ces credentials comme une « étiquette nutritionnelle » pour les contenus numériques, offrant la possibilité d’en inspecter l’historique.

Cela ne permet pas de juger de la « véracité » d’un contenu, mais aide à répondre à des questions telles que :

Qui l’a créé ?

L’IA a-t-elle été impliquée ?

Y a-t-il eu modification ?

Quel logiciel a été utilisé ?

Les données de provenance ont-elles été préservées ?

C’est essentiel pour le journalisme, les marques, la preuve légale, ou tout domaine où des médias falsifiés peuvent causer des préjudices concrets. C’est aussi pertinent en crypto, où des faux documents ou des informations générées par IA peuvent impacter les marchés.

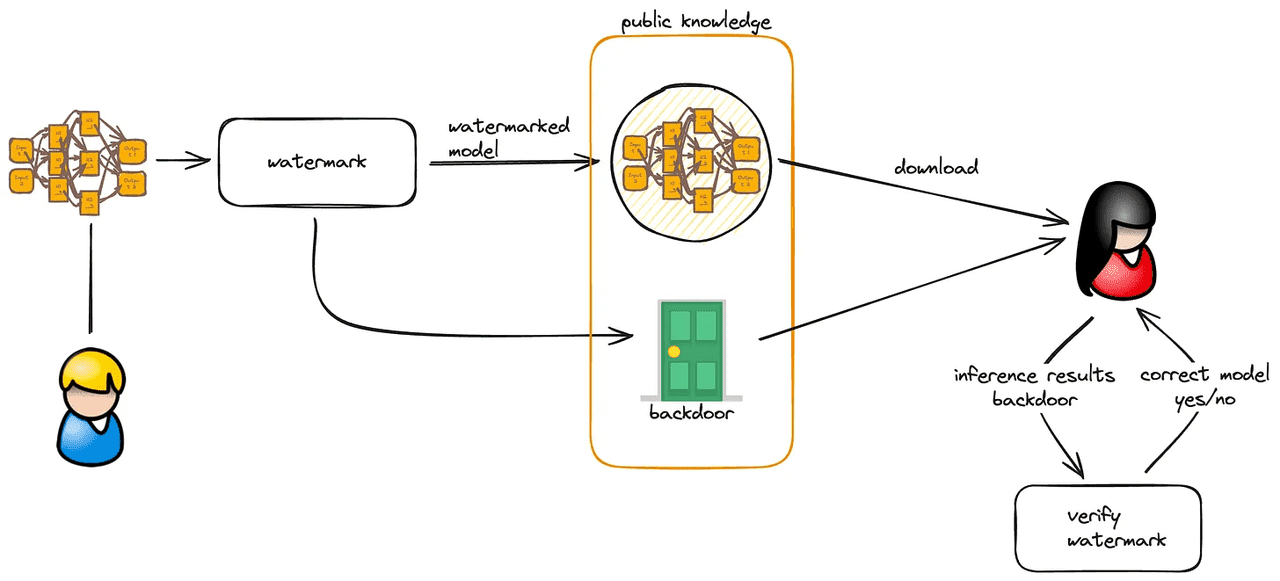

Filigranage

Autre niveau : le filigranage, qui insère des signaux invisibles dans les médias générés par l’IA pour une identification ultérieure.

SynthID de Google DeepMind en est un exemple structurant, conçu pour filigraner et reconnaître les contenus IA afin de favoriser transparence et confiance. Pour les images, le filigrane est intégré aux pixels ; des approches similaires existent pour l’audio généré.

Le filigranage est utile mais non suffisant. Le NIST note que provenance et filigrane aident à l’authentification, mais leur fiabilité, robustesse et résistance à la suppression doivent être évaluées.

Il faut donc voir le filigrane comme un élément parmi d’autres de l’IA vérifiable.

Environnements d’Exécution Sécurisés (TEE)

Autre approche : vérifier où et comment un modèle a fonctionné.

Les TEE sont des environnements matériels isolés qui peuvent attester qu’un calcul a eu lieu dans un système protégé. Chainlink explique que c’est particulièrement pertinent pour l’IA, car les poids des modèles et les données d’entrée peuvent être sensibles, et les TEE offrent un cadre sécurisé tout en préservant la confidentialité.

Cela prend toute son importance dans les réseaux de calcul décentralisé. Si les développeurs externalisent l’inférence à des machines tierces, il leur faut l’assurance que la machine a bien exécuté le modèle, sans divulguer de données ni falsifier la sortie. Les TEE apportent une attestation sur l’environnement d’exécution, même si ce n’est pas une solution parfaite.

Preuves Cryptographiques d’Inférence

Approche plus ambitieuse mais complexe : prouver le calcul IA lui-même.

C’est ici qu’interviennent l’apprentissage automatique à connaissance nulle, l’inférence vérifiable et les systèmes à base de preuves. Un panorama 2025 sur l’apprentissage automatique vérifiable par preuve à connaissance nulle recense un large champ de recherche axé sur la vérification de l’entraînement, de l’inférence ou des tests sans divulguer d’informations sensibles. Plus récemment, une publication de mars 2026 a proposé des preuves cryptographiques allégées pour l’inférence, afin d’en réduire la lourdeur calculatoire.

Ceci est fondamental, car le but ultime de l’IA vérifiable n’est pas simplement « faites confiance à ce coffre-fort », mais « voici une preuve cryptographique que le calcul a bien été effectué ». En pratique, cela reste complexe pour les grands modèles car les preuves restent coûteuses en ressources. Mais la direction est claire : rendre l’inférence IA plus vérifiable sans la rendre inutilisable.

Exemple de cas d'usage (source)

Signification de l'IA vérifiable en crypto

Dans le logiciel traditionnel, la confiance s’appuie sur la réputation, les contrats ou la supervision centralisée. En crypto, l’exigence est différente : les utilisateurs attendent des systèmes ouverts, interopérables et auditables.

Cela crée une tension. L’IA est de plus en plus utile pour le trading, l’automatisation ou la conformité, mais le résultat d’un modèle boîte noire est difficilement conciliable avec des infrastructures minimisant la confiance. Les articles récents de Chainlink sur l’orchestration IA et la pile IA vérifiable rappellent que c’est précisément là que les réseaux oracles décentralisés, le reporting par consensus et la computation vérifiable apportent une valeur ajoutée. Les entrées sont collectées et traitées sur une infrastructure décentralisée, puis retransmises on-chain, ce qui réduit la dépendance envers un opérateur unique.

Cela concerne notamment :

Les oracles IA pour marchés prédictifs, assurances ou protocoles événementiels

Les agents de trading autonomes nécessitant des données fiables et des actions auditables

Les workflows de conformité où les institutions ont besoin de preuves d’application des politiques

Les applications consommateurs on-chain souhaitant exploiter l’IA sans centraliser la confiance

En résumé, l’IA vérifiable donne un véritable sens à l’expression « IA sur blockchain ».

Exemples de tendances IA vérifiable sur le marché

Chainlink : la pile IA vérifiable

Chainlink est l’un des acteurs majeurs à présenter l’IA vérifiable comme une pile combinant IA, preuves cryptographiques et infrastructure blockchain. Le projet relie cela aux contrats intelligents, TEE, orchestration d’agents, contrats institutionnels et computation vérifiable off-chain.

Pour les lecteurs, l’essentiel n’est pas seulement l’aspect IA chez Chainlink, mais la formulation d’un cadre permettant aux résultats IA d’être suffisamment fiables pour un usage on-chain.

Lagrange : IA vérifiable basée sur les ZK

La documentation officielle de Lagrange présente explicitement le projet autour des technologies vérifiables, mentionnant le produit DeepProve comme solution pour l’IA vérifiable et affirmant que « le futur de l’IA est ZK ». Lagrange s’aligne ainsi sur la conviction que les systèmes de preuve à connaissance nulle constitueront l’infrastructure clé du calcul IA de confiance.

0G : Infrastructure pour l’IA décentralisée

Les documents de 0G abordent l’infrastructure IA décentralisée, incluant inférence, stockage et disponibilité des données. Le positionnement de 0G intègre aussi la narration « IA vérifiable ». Les docs montrent comment accéder aux services d’inférence et comment le réseau gère la disponibilité et la vérification des données via des nœuds spécialisés.

Ces exemples témoignent du fait que l’IA vérifiable n’est pas qu’un concept académique, mais devient une réalité concrète dans l’écosystème crypto.

Comment l’IA vérifiable pourrait fonctionner en pratique

Une manière utile d’aborder l’IA vérifiable est de la concevoir comme une chaîne de preuves.

Imaginons un produit d’assurance on-chain propulsé par IA :

Un utilisateur soumet une réclamation avec documents et images.

Un modèle analyse la demande hors chaîne.

Le système enregistre la provenance du contenu soumis et généré.

Le modèle fonctionne dans un TEE ou un environnement attesté.

Un réseau décentralisé vérifie les entrées ou agrège les résultats.

Le résultat est signé, journalisé et rapporté on-chain.

Le contrat intelligent agit uniquement si toutes les preuves requises sont validées.

Chaque système n’implémente pas l’ensemble de ces étapes, mais l’idée reste de rendre chaque étape critique plus transparente et difficile à falsifier. Les récents supports de Chainlink sur les contrats institutionnels et l’orchestration IA collent à cette architecture, tandis que C2PA et le filigranage répondent à la question de la provenance média.

Rôle des données dans l’IA vérifiable (source)

Avantages de l'IA vérifiable

Le principal avantage : davantage de confiance. Mais cette confiance apporte aussi des bénéfices concrets.

Premièrement, l’IA vérifiable favorise l’auditabilité : au lieu de demander aux utilisateurs de croire un fournisseur de modèles, le système fournit des artefacts (credentials, signatures, attestations, preuves).

Deuxièmement, elle facilite la conformité réglementaire. Les supports de Chainlink sur la conformité et les contrats intelligents institutionnels montrent son intérêt pour la finance régulée : preuve de l’application des règles, audit facilité…

Troisièmement, elle renforce la résistance à la manipulation. Les systèmes de provenance et de filigranage ne stopperont pas tous les deepfakes, mais rendent les modifications plus détectables et l’authenticité plus solide.

Quatrièmement, elle améliore l’interopérabilité Web3. Les contrats, agents et protocoles peuvent exploiter l’IA plus sereinement s’ils ont accès aux preuves attachées à une sortie.

Limites et risques

L’IA vérifiable est prometteuse, mais non miraculeuse.

Différentes méthodes vérifient des aspects différents. Un filigrane peut indiquer qu’un média est généré par IA, mais non garantir la véracité du contenu. Un enregistrement de provenance retrace l’historique, mais ne certifie pas l’exactitude. Un TEE atteste de l’environnement, mais pas forcément de toutes les propriétés attendues. Les systèmes de preuve restent coûteux pour les grands modèles.

Autre défi : la fragmentation des standards. C2PA est utile pour la provenance, mais pas pour l’exécution IA. Les systèmes ZK progressent, mais ne couvrent pas encore tous les usages IA. Les TEE créent des hypothèses de confiance autour du matériel.

Un compromis s’impose entre coût et performance : plus la vérification est forte, plus le surcoût est important. Cela explique la recherche actuelle sur des systèmes de preuve plus légers ou hybrides. Enfin, un risque de marché existe : certains projets pourraient utiliser le terme « IA vérifiable » alors que la portée de leur vérification est limitée.

Conclusion

L’IA vérifiable s’impose comme une idée clé à l’intersection de l’IA et de la crypto car elle s’attaque à l’opacité des systèmes IA modernes.

À mesure que l’IA se déploie dans les applications financières, les agents on-chain, les médias, les processus conformité ou les logiciels autonomes, les utilisateurs auront besoin de plus que de simples résultats : preuves, provenance, attestations, audit trails. Voilà la vraie promesse de l’IA vérifiable.

La catégorie reste émergente (avril 2026), sans architecture universelle. Elle se structure comme une pile : standards de provenance (C2PA), outils de filigranage (SynthID), TEE, systèmes de preuve avancés… Des acteurs comme Chainlink, Lagrange et 0G font progresser chaque brique.

En résumé, l’IA vérifiable consiste à passer d’une IA qu’on utilise à une IA qu’on peut inspecter et vérifier. Si la tendance se confirme, cela pourrait devenir l’un des fondements de la prochaine génération d’applications crypto pilotées par l’IA.

À mesure que l’IA et la blockchain convergent, des concepts comme l’IA vérifiable gagneront en importance. Si vous souhaitez explorer les secteurs crypto émergents de l’IA, du DePIN, des RWA et de l’infrastructure on-chain, Phemex propose une plateforme fiable et intuitive pour suivre les tendances, explorer de nouvelles opportunités et affiner vos stratégies de trading.