Wichtigste Erkenntnisse

Verifiable AI bedeutet, dass KI-Ausgaben, Modellverhalten oder Inhaltsherkunft mit Belegen versehen werden – nicht nur mit Behauptungen.

In der Praxis umfasst Verifiable AI Herkunftsnachweise (Provenance), Wasserzeichen, kryptografische Signaturen, Trusted Execution Environments (TEEs) sowie [Zero-Knowledge-Proofs]Zero-Knowledge-Proofs oder andere Nachweissysteme für Inferenz.

Das Konzept ist besonders im Kryptobereich relevant, da Smart Contracts nicht sicher auf undurchsichtige Offchain-KI-Ausgaben vertrauen können, ohne eine vertrauensminimierende Verifizierungsschicht.

Stand April 2026 gibt es vielfältige Infrastruktur-Ansätze, etwa von Chainlink, Lagrange und 0G, dazu breit gefasste Provenance-Standards wie C2PA Content Credentials und Medien-Wasserzeichentools wie SynthID.

Verifiable AI ist vielversprechend, aber noch in einem frühen Stadium. Es existiert noch kein universeller Standard; verschiedene Systeme prüfen unterschiedliche Aspekte.

Künstliche Intelligenz wird leistungsfähiger, doch das Vertrauen in ihre Ergebnisse sinkt.

Wenn ein KI-Modell einen Bericht zusammenfasst, eine Transaktion markiert, einen Vermögenswert bewertet, eine Onchain-Aktion auslöst oder ein Bild erzeugt, müssen Nutzer oft darauf vertrauen, dass das System wie behauptet arbeitet. In vielen Fällen können sie nicht unabhängig überprüfen, welches Modell das Ergebnis erzeugt hat, welche Daten verwendet wurden, ob die Ausgabe verändert wurde oder ob das Modell in einer zugelassenen Umgebung lief. Diese Vertrauenslücke adressiert Verifiable AI. OpenAI beschreibt Verifizierbarkeit als Fähigkeit, Belege für Behauptungen über KI-Systeme zu liefern, während NIST Methoden wie Wasserzeichen, kryptografische Signaturen, digitale Fingerabdrücke und Modellintegritäts-Prüfungen zur Unterstützung von Herkunftsnachweisen und vertrauenswürdiger KI empfiehlt.

Verifiable AI umfasst Ansätze, die KI-Systeme auditierbar, überprüfbar und manipulationssicher machen. Je nach Anwendungsfall bedeutet das: Die Herkunft KI-generierter Inhalte belegen, nachweisen, dass ein bestimmtes Modell wie behauptet lief, dass Ein- und Ausgaben nicht verändert wurden oder dass eine Offchain-KI-Berechnung für eine Onchain-Anwendung nachvollziehbar ist. Die aktuelle Beschreibung des „verifizierbaren KI-Stacks“ von Chainlink bringt es auf den Punkt: KI wird mit kryptografischen Nachweisen und Blockchain-Infrastruktur kombiniert, sodass Smart Contracts KI-Ausgaben nutzen können und Integritätsgarantien für Offchain-Operationen erhalten.

Verifiable AI ist also keine einzelne Lösung oder ein Token. Es ist ein Gestaltungsprinzip: Nutzer sollen Belege für KI-Ausgaben erhalten, nicht nur Vertrauen einfordern.

Was bedeutet „Verifiable AI“ konkret?

Der Begriff klingt abstrakt. Die Kernfrage lautet:

Was genau wird überprüft?

Das kann Verschiedenes bedeuten:

Überprüfung der Herkunft (Provenance) — Wurde dieses Bild, Video, Audio oder Dokument von KI erstellt oder bearbeitet, und wie ist sein Verlauf? Der C2PA-Standard für Content Credentials setzt genau hier an: Content Credentials dienen dazu, die Herkunft digitaler Inhalte zu sichern und Aussagen über deren Erstellung oder Veränderung zu verknüpfen.

Überprüfung der Generierung — Wurde der Inhalt von einem zugelassenen KI-System erzeugt? SynthID von Google DeepMind ist ein Beispiel für Wasserzeichentechnologie zur Erkennung KI-generierter oder KI-veränderter Inhalte.

Überprüfung der Ausführung — Lief das KI-Modell wie angegeben mit den vorgesehenen Eingaben in der vorgesehenen Umgebung und ohne Manipulation? Hier kommen TEEs, Attestierungs- und beweisbasierte Inferenzsysteme ins Spiel. Die Bildungsressourcen und aktuellen Beiträge von Chainlink verbinden dieses Problem direkt mit sicherer Modellausführung und vertrauenswürdiger Berechnung.

Verifizierung von Berechnungen für Blockchains — Kann ein Smart Contract auf eine KI-Ausgabe reagieren, wenn die Modellberechnung Offchain stattfand? Da Blockchains Offchain-Inferenzen nicht direkt einsehen können, werden verifizierbare Berechnungsschichten essenziell, wenn KI entscheidende Onchain-Aktionen anstoßen soll.

Sagt jemand „Verifiable AI“, kann damit eine oder mehrere dieser Ebenen gemeint sein. Daher ist die Kategorie breit gefasst: Ein Team fokussiert sich auf Medien-Authentifizierung, ein anderes auf korrekte Inferenz, ein weiteres auf auditierbare KI-Agenten in Onchain-Prozessen.

Warum Verifiable AI wichtig ist

KI ist nützlich, weil sie dort agiert, wo Menschen nicht alles manuell prüfen können. Das macht Verifizierung umso wichtiger, wenn die Ergebnisse entscheidend sind.

Beispiele:

Ein KI-Modell markiert verdächtige Transaktionen für eine regulierte Finanzplattform.

Ein KI-Oracle liefert Ereignisanalyse für einen Prognosemarkt.

Ein autonomer KI-Agent balanciert ein Onchain-Portfolio aus.

Ein generiertes Bild oder Video verbreitet sich schnell während eines marktrelevanten Ereignisses.

Ein Unternehmen benötigt einen Nachweis, dass ein Modell bestimmte Datenschutz- oder Compliance-Auflagen einhält.

In all diesen Fällen reicht „das Modell sagt es“ nicht aus. Die NIST-Empfehlungen zur Risikominimierung synthetischer Inhalte betonen Wasserzeichen und Inhaltsauthentifizierung, während OpenAI Verifizierbarkeit als Möglichkeit sieht, Belege für Sicherheit, Fairness oder Datenschutzfreundlichkeit zu liefern.

Im Kryptobereich ist das noch bedeutsamer. Blockchains sind auf Vertrauensminimierung ausgelegt, KI-Systeme hingegen oft intransparent und schwer auditierbar. Chainlink argumentiert, dass verifizierbare KI und die Orchestrierung von KI-Agenten nötig sind, um Offchain-Datenverarbeitung und modellgesteuerte Workflows transparent und konform Onchain zu bringen.

Deshalb wird Verifiable AI zu einem wichtigen Teilbereich von KI x Krypto. Es schlägt die Brücke zwischen intelligenten und vertrauensminimierten Systemen.

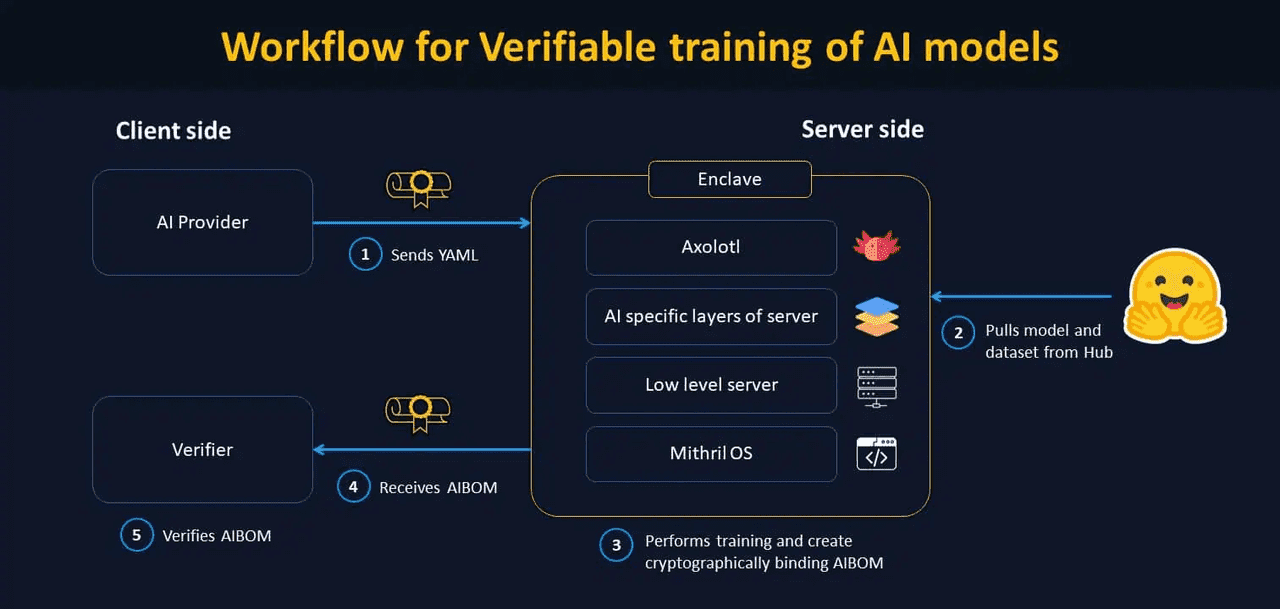

Verifizierbarer Workflow für das Training von KI (Quelle)

Die wichtigsten Bausteine von Verifiable AI

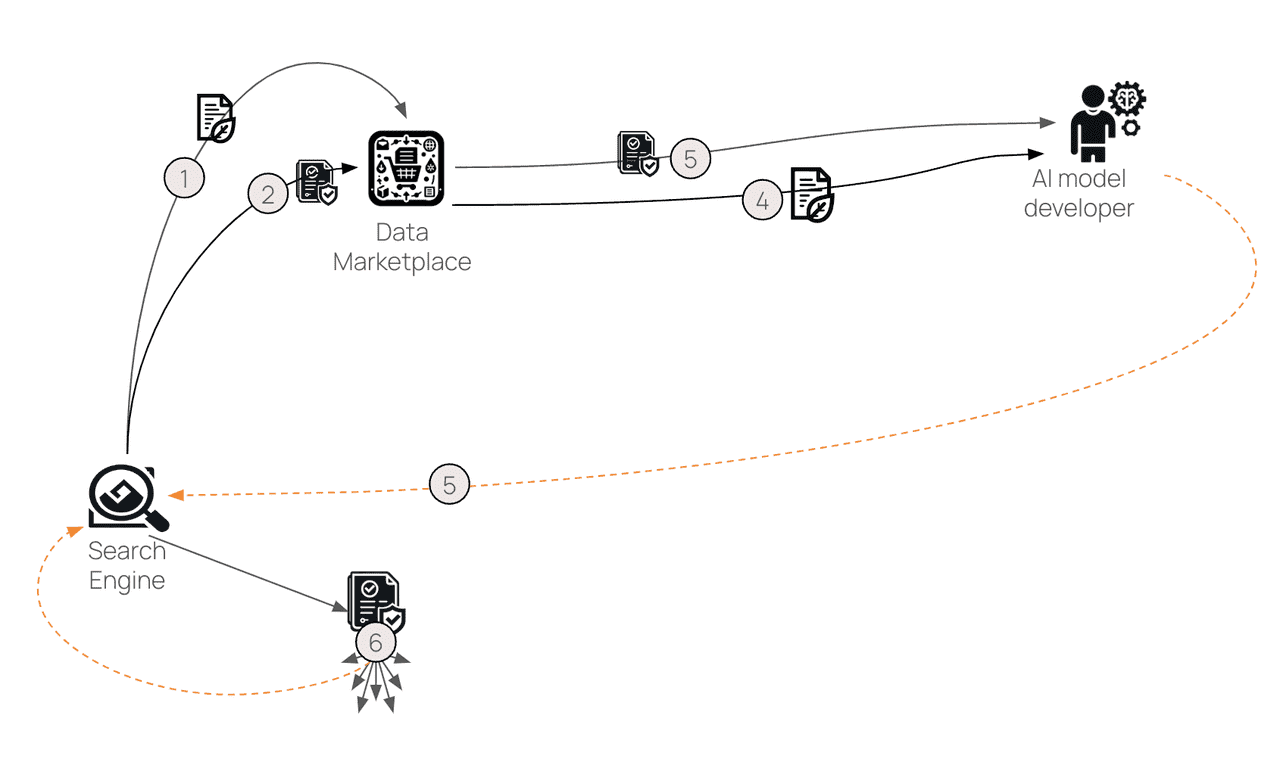

Herkunftsnachweis und Content Credentials

Eine der einfachsten Formen von Verifiable AI ist der Nachweis der Quelle von Inhalten.

Das C2PA-Framework gehört zu den führenden Standards. Laut C2PA schaffen Content Credentials die Möglichkeit, die Herkunft von Inhalten zu belegen und sie mit den Medien zu verknüpfen. Die Website beschreibt Content Credentials als eine Art „Nährwerttabelle“ für digitale Inhalte, die Nutzern die Überprüfung der Historie ermöglicht.

Das beantwortet nicht automatisch die Frage nach der „Wahrheit“ eines Inhalts, hilft aber bei:

Wer hat es erstellt?

War KI beteiligt?

Wurde es bearbeitet?

Mit welcher Software?

Wurde die Provenance-Daten erhalten?

Das ist relevant für Journalismus, Marken, Recht und überall, wo gefälschte oder manipulierte Medien Schaden anrichten können – und ebenso für Krypto, wo gefälschte Screenshots und KI-generierte Falschinformationen die Märkte beeinflussen können.

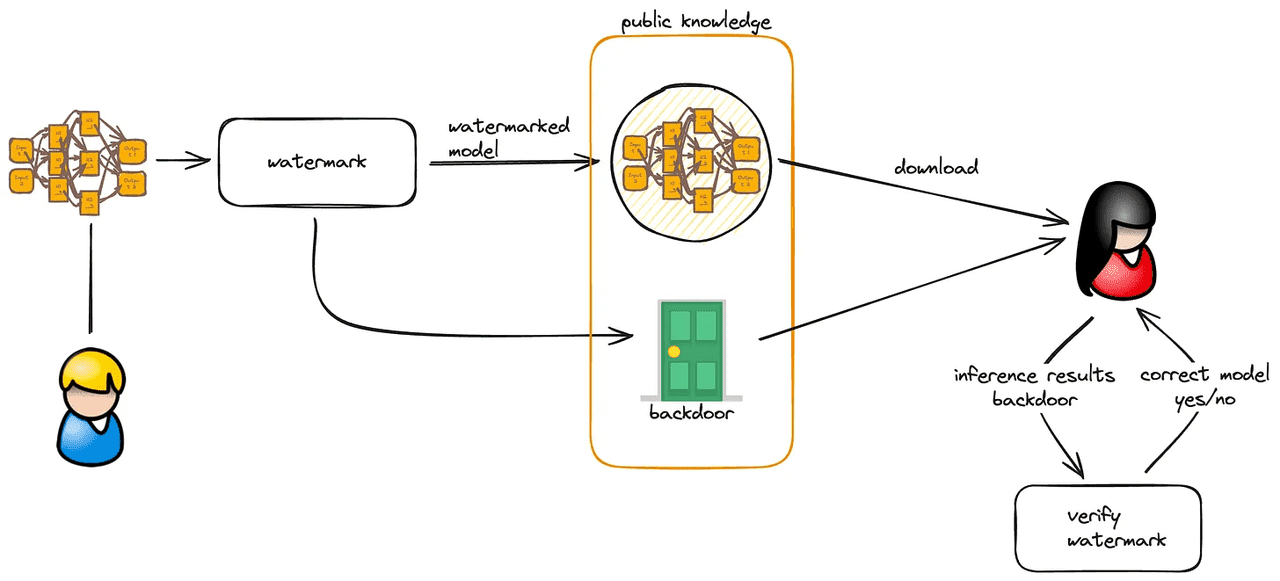

Wasserzeichen

Eine weitere Ebene sind Wasserzeichen: Signale, die in KI-generierte Medien eingebettet werden, um sie später zu identifizieren.

SynthID von Google DeepMind ist ein klares Beispiel. DeepMind beschreibt es als Werkzeug für Wasserzeichen und Identifikation KI-generierter Inhalte, um Transparenz und Vertrauen in generative KI zu fördern. Für Bilder wird ein kaum wahrnehmbares Wasserzeichen in die Pixel eingearbeitet; DeepMind geht auch auf Audiowasserzeichen für generierte Musik und Sound ein.

Wasserzeichen sind nützlich, aber keine Komplettlösung. NIST betont, dass Provenance und Wasserzeichen zur Authentifizierung beitragen, aber auf Zuverlässigkeit, Robustheit und Widerstandsfähigkeit gegen Entfernung geprüft werden müssen.

Daher sind Wasserzeichen ein Teil von Verifiable AI – nicht die gesamte Lösung.

Trusted Execution Environments (TEEs)

Ein weiterer Ansatz ist die Verifizierung von Ort und Ablauf der Modellausführung.

TEEs sind hardwareisolierte Umgebungen, die belegen können, dass eine Berechnung in einem geschützten System stattgefunden hat. Chainlink betont, dass TEEs besonders für KI sinnvoll sind, da Modellgewichte und Eingabedaten vertraulich sein können und TEEs sichere Umgebungen für verifizierbare KI ermöglichen.

Gerade in dezentralen Computenetzwerken ist das wichtig. Wird die Inferenz an Dritte ausgelagert, muss sichergestellt werden, dass das richtige Modell läuft, Daten nicht offengelegt und Ausgaben nicht gefälscht werden. TEEs bieten hier Attestierungen über die Laufzeitumgebung, sind aber keine perfekte Lösung.

Kryptografische Nachweise der Inferenz

Ein anspruchsvollerer Ansatz ist der Nachweis der gesamten KI-Berechnung.

Hier kommen Zero-Knowledge-Machine-Learning, verifizierbare Inferenz und beweisbasierte Systeme ins Spiel. Eine Studie von 2025 zu ZKP-basierter verifizierbarer KI beschreibt ein breites Forschungsfeld zur Verifizierung von Training, Inferenz oder Tests ohne Offenlegung sensibler Informationen. Ein Paper von März 2026 schlägt leichte kryptografische Nachweise für Inferenz vor, um den hohen Aufwand klassischer Nachweissysteme zu verringern.

Das Ziel ist: Nicht nur „dieser Kasten ist sicher“, sondern: „Hier ist ein kryptografischer Nachweis, dass die Berechnung korrekt lief.“ Für große Modelle ist dies noch ressourcenintensiv. Aber die Forschung arbeitet daran, Inferenz überprüfbar zu machen, ohne zu große Performance-Einbußen.

Beispiel für einen Anwendungsfall (Quelle)

Was Verifiable AI für Krypto bedeutet

In traditioneller Software basiert Vertrauen oft auf Reputation, Verträgen und zentraler Kontrolle. Im Kryptobereich erwarten Nutzer offene, flexibel kombinierbare und unabhängig prüfbare Systeme.

Das führt zu Konflikten: KI ist für Handel, Automatisierung, Compliance und Prognosen zunehmend nützlich, aber die Ergebnisse eines Black-Box-Modells sind schwer mit vertrauensminimierter Infrastruktur zu vereinen. Chainlink argumentiert, dass dezentrale Oracles, konsensbasierte Berichte und verifizierbare Berechnung hier eine große Rolle spielen. Daten können in dezentraler Infrastruktur verarbeitet und dann Onchain so gemeldet werden, dass kein einzelner Betreiber zum Single Point of Failure wird.

Besonders relevant ist dies für:

KI-Oracles für Prognosemärkte, Versicherungen oder ereignisgesteuerte Protokolle

Autonome Handelsagenten, die verlässliche Daten und prüfbare Aktionen benötigen

Compliance-Prozesse, bei denen Institutionen Nachweise für Richtlinienumsetzung fordern

Onchain-Apps, die KI nutzen wollen, ohne Vertrauen zu zentralisieren

Kurz: Verifiable AI macht „KI auf Blockchain“ zu mehr als einem Marketingbegriff.

Beispiele für Verifiable-AI-Ansätze im Markt

Chainlink: Der Verifiable AI Stack

Chainlink positioniert Verifiable AI als Stack aus KI, kryptografischen Nachweisen und Blockchain-Infrastruktur. Die aktuellen Materialien stellen die Verbindung zu Smart Contracts, TEEs, Agentenorchestrierung, institutionellen Smart Contracts und verifizierbarer Offchain-Berechnung her.

Für Leser der Academy ist entscheidend: Nicht einfach „Chainlink macht KI“, sondern: Chainlink entwickelt einen Rahmen, wie KI-Ausgaben vertrauenswürdig Onchain genutzt werden können.

Lagrange: ZK-basierte Verifiable AI

Lagrange positioniert sich klar im Bereich verifizierbare Technologie, das Produkt DeepProve richtet sich auf verifizierbare KI. Lagrange sieht: „Die Zukunft der KI ist ZK.“ Zero-Knowledge-Proof-Systeme werden damit als Basisinfrastruktur für vertrauenswürdige KI-Berechnungen angesehen.

0G: Infrastruktur für dezentrale KI

0G ist breiter aufgestellt als nur Verifizierbarkeit, aber die Infrastruktur verbindet dezentrale KI-Inferenz, Storage und Datenverfügbarkeit. In öffentlichen Materialien betont 0G auch „verifizierbare KI“ als Teil seines Infrastruktur-Ansatzes. Die Dokumentation zeigt, wie Entwickler auf Inferenzdienste zugreifen und wie das Netzwerk Datenverfügbarkeit und -verifizierung über spezialisierte Knoten gewährleistet.

Diese Beispiele zeigen: Verifiable AI ist nicht nur ein akademischer Begriff, sondern entwickelt sich zu einem realen Produkt- und Infrastrukturthema im Kryptomarkt.

Wie Verifiable AI praktisch funktionieren kann

Verifiable AI lässt sich als Beweiskette verstehen.

Beispiel: Ein Onchain-KI-Versicherungsprodukt könnte so funktionieren:

Ein Nutzer reicht einen Antrag mit Bildern und Dokumenten ein.

Ein Modell analysiert den Antrag Offchain.

Das System dokumentiert die Herkunft der eingereichten und generierten Medien.

Das Modell läuft in einer TEE oder einer attestierten Umgebung.

Ein dezentrales Netzwerk prüft die Eingaben oder aggregiert die Modellergebnisse.

Das Ergebnis wird signiert, protokolliert und Onchain gemeldet.

Der Smart Contract handelt nur, wenn die nötigen Nachweise vorhanden sind.

Verschiedene Systeme implementieren unterschiedliche Teile dieser Kette, aber das Ziel bleibt: Jeder entscheidende Schritt ist transparenter und schwer manipulierbar. Chainlink und andere Materialien zur KI-Orchestrierung und zu institutionellen Smart Contracts orientieren sich eng an solchen Architekturen, während C2PA und Wasserzeichensysteme die Medien- und Provenance-Seite abdecken.

Rolle der Daten bei Verifiable AI (Quelle)

Vorteile von Verifiable AI

Der größte Vorteil: Mehr Vertrauen. Das spiegelt sich in mehreren Aspekten wider.

Erstens verbessert Verifiable AI die Auditierbarkeit. Statt bloß einer Behauptung können Systeme Nachweise wie Credentials, Signaturen, Attestierungen oder Proofs liefern.

Zweitens profitieren Compliance-Prozesse. Chainlink zeigt, warum regulierte Finanzdienstleister Wert darauf legen: Richtlinienumsetzung, Berichte und Audit-Trails werden erleichtert, wenn die Infrastruktur Nachweise bereitstellt.

Drittens stärkt es die Widerstandsfähigkeit gegen Manipulationen. Provenance-Systeme und Wasserzeichen verhindern nicht alle Deepfakes oder Falschinformationen, erleichtern aber die Erkennung von Manipulationen und liefern stärkere Authentizitätssignale.

Viertens fördert es die Kombinierbarkeit im Web3. Smart Contracts, Agenten und Protokolle können KI sicherer nutzen, wenn sie die zugehörigen Nachweise prüfen können, statt blind zu vertrauen.

Einschränkungen und Risiken

Verifiable AI ist vielversprechend, aber keine Zauberei.

Ein Nachweisverfahren prüft jeweils nur bestimmte Aspekte. Ein Wasserzeichen zeigt, dass Medien von KI erzeugt wurden, belegt aber nicht die Richtigkeit der Inhalte. Ein Provenance-Datensatz dokumentiert die Bearbeitung, aber nicht die inhaltliche Korrektheit. Ein TEE bestätigt die Laufzeitumgebung, nicht aber jede gewünschte Eigenschaft. Und Nachweissysteme für Inferenz sind bei großen Modellen oft noch ressourcenintensiv.

Ein weiteres Problem: Es gibt keinen einheitlichen Standard. C2PA ist wichtig für Provenance, aber nicht für KI-Ausführung. ZK-Systeme entwickeln sich weiter, sind aber noch nicht für alle KI-Anwendungen die Laufzeitumgebung. TEEs sind praktisch, aber bringen eigene Vertrauensannahmen mit.

Zudem besteht ein Trade-off zwischen Kosten und Leistung. Stärkere Verifizierung erhöht oft den Aufwand. Aktuelle Forschung sucht daher nach leichteren Proof-Systemen und Hybridansätzen. Im Kryptomarkt besteht das Risiko, dass Projekte sich mit „Verifiable AI“ schmücken, aber nur begrenzte Verifizierung bieten.

Fazit

Verifiable AI ist eine der wichtigsten Entwicklungen an der Schnittstelle von KI und Krypto, denn sie adressiert ein Grundproblem moderner KI: Intransparenz.

Je tiefer KI in Finanz-Apps, Onchain-Agenten, Medien, Compliance-Prozesse und autonome Software eingebettet wird, desto mehr werden Nutzer Belege, Provenance, Attestierungen und Audit-Trails benötigen. Genau das verspricht Verifiable AI.

Die Kategorie ist Stand April 2026 noch jung, ein einheitliches Framework gibt es nicht. Stattdessen entsteht eine Schichtstruktur: Provenance-Standards wie C2PA, Wasserzeichentools wie SynthID, vertrauenswürdige Laufzeitumgebungen wie TEEs und fortgeschrittene Nachweissysteme für Inferenz und Onchain-Abwicklung. Anbieter wie Chainlink, Lagrange und 0G treiben die Entwicklung voran.

Kurz: Verifiable AI macht aus KI ein prüfbares und belegbares Werkzeug. Sollte sich dieser Ansatz durchsetzen, könnte er die nächste Generation KI-gestützter Kryptoanwendungen prägen.

Mit der Annäherung von KI und Blockchain werden Themen wie Verifiable AI für Trader und Entwickler immer wichtiger. Wer neue Krypto-Sektoren – von KI-Agenten über DePIN bis RWAs und Onchain-Infrastruktur – frühzeitig verfolgen möchte, findet auf Phemex eine sichere, benutzerfreundliche Plattform zur Marktanalyse und Erschließung neuer Chancen.