Ý chính rút ra

AI có thể xác minh là khái niệm rằng đầu ra của AI, hành vi mô hình hoặc nguồn gốc nội dung cần đi kèm bằng chứng, không chỉ dựa vào khẳng định.

Trong thực tế, AI có thể xác minh bao gồm chứng thực nguồn gốc, đánh dấu watermark, chữ ký mật mã, môi trường thực thi tin cậy (TEE) và các hệ thống bằng chứng như bằng chứng không kiến thức (zero-knowledge proof) cho suy luận.

Khái niệm này đặc biệt quan trọng trong lĩnh vực tiền điện tử vì các smart contract không thể dựa vào đầu ra AI bên ngoài mà không có lớp xác minh tối thiểu hóa niềm tin.

Tính đến tháng 4/2026, lĩnh vực này có sự xuất hiện của các dự án hạ tầng như Chainlink, Lagrange và 0G, cùng với các tiêu chuẩn nguồn gốc rộng hơn như C2PA Content Credentials và công cụ watermarking như SynthID.

AI có thể xác minh mang lại nhiều tiềm năng nhưng vẫn trong giai đoạn đầu. Chưa có tiêu chuẩn chung và các hệ thống xác minh những khía cạnh khác nhau.

Trí tuệ nhân tạo ngày càng mạnh mẽ nhưng cũng đồng thời khó kiểm chứng hơn.

Khi một mô hình AI tóm tắt báo cáo, gắn cờ giao dịch, định giá tài sản, kích hoạt hành động onchain hoặc tạo hình ảnh, người dùng thường phải tin rằng hệ thống đã thực hiện đúng như đã công bố. Trong nhiều trường hợp, họ không thể tự xác minh mô hình nào đã tạo ra kết quả, dữ liệu nguồn là gì, đầu ra có bị thay đổi không hay mô hình có chạy trong môi trường được chấp thuận không. Khoảng cách niềm tin này chính là điều mà AI có thể xác minh hướng tới giải quyết. OpenAI mô tả khả năng xác minh của AI là việc cung cấp bằng chứng cho các khẳng định về hệ thống AI, trong khi NIST nhấn mạnh các kỹ thuật như watermarking, chữ ký mật mã, dấu vân tay số và xác minh tính toàn vẹn mô hình để hỗ trợ nguồn gốc nội dung và hệ thống AI đáng tin cậy.

Ở cấp độ tổng quan, AI có thể xác minh đề cập đến các phương pháp giúp hệ thống AI dễ kiểm toán, có thể chứng minh và dễ nhận biết khi bị can thiệp. Tùy theo từng trường hợp, điều này có thể là chứng minh nguồn gốc nội dung tạo bởi AI, xác minh mô hình đã chạy như công bố, đảm bảo đầu vào - đầu ra không bị thay đổi, hoặc chứng minh một phép tính AI offchain có thể được ứng dụng onchain tin cậy. Mô tả gần đây của Chainlink về "verifiable AI stack" cho thấy việc kết hợp AI, bằng chứng mật mã và hạ tầng blockchain giúp smart contract tiêu thụ đầu ra AI đi kèm cam kết về tính toàn vẹn khi thực thi ngoài chuỗi.

Nói cách khác, AI có thể xác minh không phải là một sản phẩm hay token cụ thể mà là triết lý thiết kế rộng: Đừng chỉ yêu cầu người dùng tin AI — hãy cung cấp bằng chứng.

"AI có thể xác minh" thực sự nghĩa là gì?

Khái niệm này có thể trừu tượng, nên hãy đặt thành câu hỏi đơn giản:

Chúng ta đang xác minh điều gì?

Có thể là những yếu tố sau:

Xác minh nguồn gốc — Hình ảnh, video, đoạn âm thanh hay tài liệu này do AI tạo/chỉnh sửa không, và lịch sử của nó thế nào? Tiêu chuẩn Content Credentials của C2PA xoay quanh ý tưởng này, mô tả Content Credentials như cách xác lập nguồn gốc và gắn an toàn thông tin về quá trình tạo hay chỉnh sửa nội dung số.

Xác minh quá trình tạo — Nội dung này có phải do hệ thống AI được phê duyệt tạo ra không? SynthID của Google DeepMind là ví dụ về phương pháp watermark nhằm nhận diện nội dung do AI tạo hoặc chỉnh sửa.

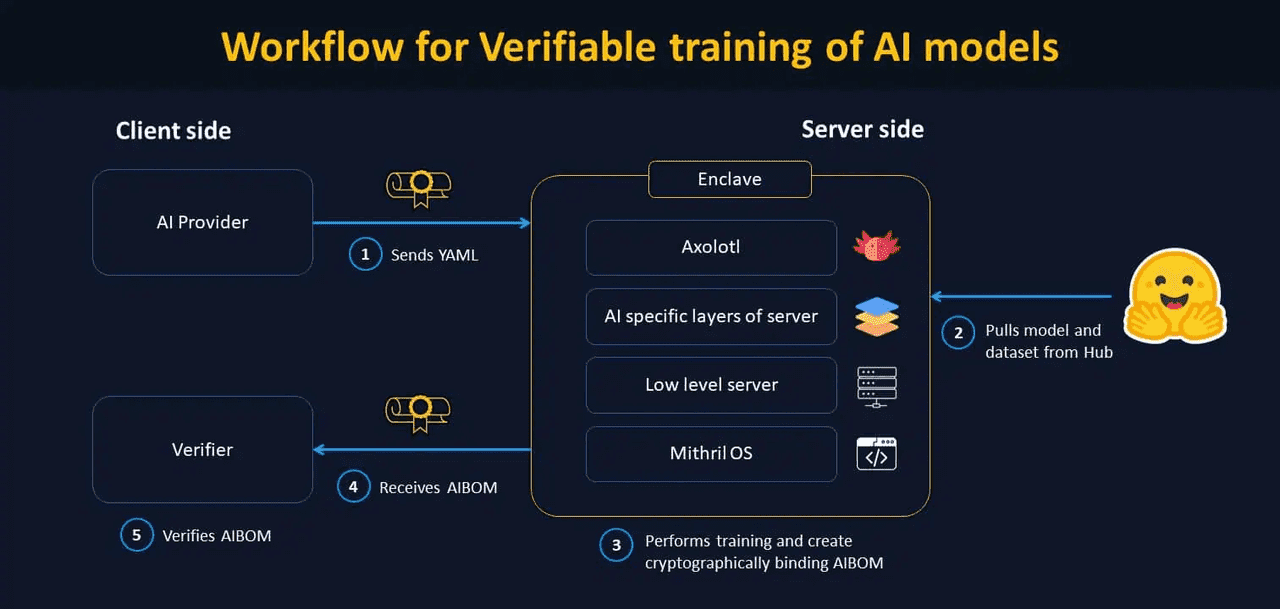

Xác minh thực thi — Mô hình AI có chạy đúng như công bố, trên đầu vào mong muốn, trong môi trường xác thực không bị can thiệp không? Đây là nơi các TEE, hệ thống xác thực và hệ thống suy luận dựa trên bằng chứng phát huy vai trò. Tài liệu của Chainlink cũng đề cập rõ vấn đề này liên quan thực thi mô hình an toàn và tính toán đáng tin cậy.

Xác minh tính toán cho blockchain — Smart contract có thể hành động an toàn dựa trên đầu ra AI offchain không? Vì blockchain không thể kiểm tra trực tiếp các phép tính ngoài chuỗi, các lớp tính toán và bằng chứng có thể xác minh trở nên thiết yếu khi AI kích hoạt các hành động onchain có giá trị lớn.

Vì vậy khi nói "AI có thể xác minh", người ta có thể đề cập một hoặc nhiều lớp trên. Đó là lý do lĩnh vực này rộng: một nhóm tập trung xác thực phương tiện, nhóm khác muốn chứng minh tính đúng đắn suy luận, nhóm khác hướng đến khả năng kiểm toán cho AI agent trong quy trình onchain.

Vì sao AI có thể xác minh quan trọng

AI hữu ích chính vì nó có thể thực hiện những việc con người không thể kiểm tra toàn bộ. Nhưng điều này cũng đặt ra vấn đề: nếu đầu ra quan trọng, nhu cầu xác minh càng lớn.

Ví dụ:

AI gắn cờ giao dịch đáng ngờ cho nền tảng tài chính tuân thủ quy định.

Oracle AI cung cấp phân tích sự kiện cho thị trường dự đoán.

AI agent tự động cân bằng danh mục onchain.

Hình ảnh hay video lan truyền trong sự kiện làm biến động thị trường.

Doanh nghiệp muốn bằng chứng mô hình tuân thủ ràng buộc dữ liệu hay chính sách.

Ở những trường hợp này, niềm tin không thể chỉ dựa vào "mô hình nói vậy". Hướng dẫn của NIST về giảm rủi ro nội dung tổng hợp nhấn mạnh watermarking và xác thực nội dung như công cụ hỗ trợ nguồn gốc và tính toàn vẹn, trong khi nghiên cứu của OpenAI coi xác minh là cách cung cấp bằng chứng về độ an toàn, bảo mật, công bằng hoặc quyền riêng tư của hệ thống AI.

Tiền điện tử càng làm nổi bật vấn đề này. Blockchain được thiết kế để tối thiểu hóa niềm tin, nhưng AI lại thường bí ẩn, ngoài chuỗi, khó kiểm toán. Đó là sự không tương thích tự nhiên. Tài liệu Chainlink nêu rõ: cần AI có thể xác minh và AI agent orchestration để xử lý dữ liệu ngoài chuỗi, quy trình do mô hình điều khiển có thể được báo cáo lại onchain một cách minh bạch, kiểm toán được, tuân thủ chính sách.

Đó là lý do AI có thể xác minh đang trở thành một trong những tiểu phân quan trọng trong AI kết hợp tiền điện tử — nhằm thu hẹp khoảng cách giữa hệ thống thông minh và hệ thống tối thiểu hóa niềm tin.

Quy trình xác minh huấn luyện AI (nguồn)

Các thành phần chính của AI có thể xác minh

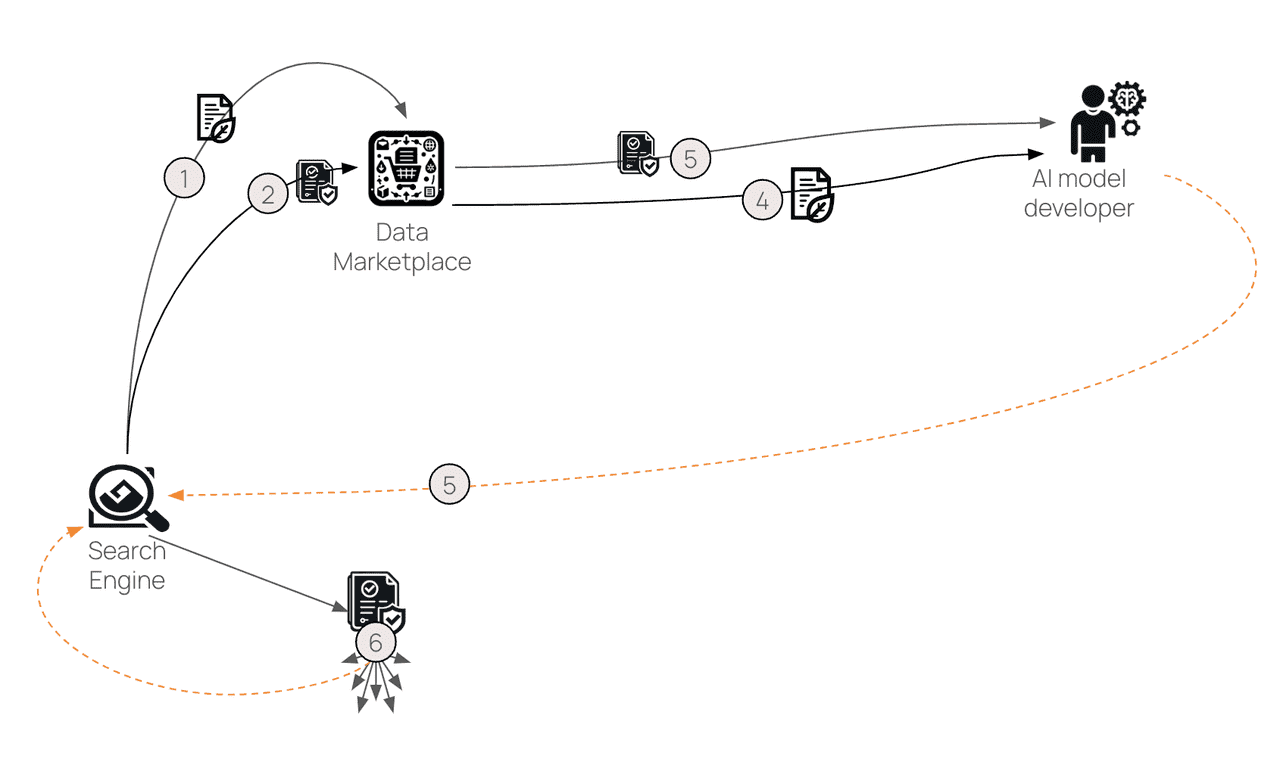

Nguồn gốc & Content Credentials

Một hình thức đơn giản của AI có thể xác minh là chứng minh nguồn gốc nội dung.

Khung C2PA là một trong các tiêu chuẩn hàng đầu. Theo giải thích, Content Credentials cung cấp cách xác lập nguồn gốc và gắn chặt thông tin này với phương tiện truyền thông. Trang web của nhóm mô tả Content Credentials như “nhãn dinh dưỡng” cho nội dung số, giúp kiểm tra lịch sử nội dung.

Điều này không thể hiện nội dung là “đúng”, nhưng giúp trả lời các câu hỏi:

Ai tạo ra?

Có AI tham gia không?

Có chỉnh sửa không?

Phần mềm nào đã thao tác?

Dữ liệu nguồn gốc còn nguyên vẹn không?

Điều này quan trọng với báo chí, thương hiệu, bằng chứng pháp lý và môi trường cần xác thực phương tiện. Nó cũng quan trọng với tiền điện tử, nơi ảnh chụp màn hình giả, tài liệu giả, thông tin sai lệch do AI có thể khiến thị trường biến động nhanh chóng.

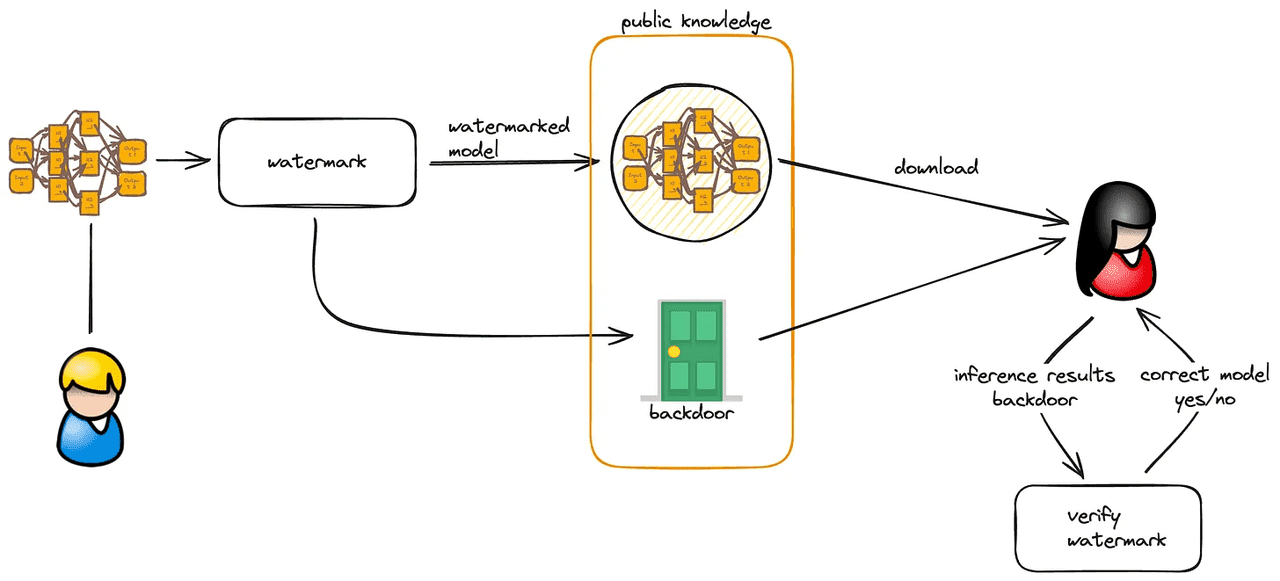

Đánh dấu Watermark

Một lớp khác là watermarking: nhúng tín hiệu vào phương tiện do AI tạo để nhận biết sau này.

SynthID của Google DeepMind là ví dụ rõ nét. DeepMind mô tả đây là công cụ watermark và nhận diện nội dung do AI tạo, hỗ trợ minh bạch và tin cậy trong AI tạo sinh. Với hình ảnh, hệ thống nhúng watermark không thể nhìn thấy vào pixel; DeepMind cũng mô tả phương pháp watermark âm thanh cho nhạc và âm thanh tạo bởi AI.

Watermark hữu ích nhưng không phải giải pháp toàn diện. Hướng dẫn NIST chỉ ra watermark và xác thực nguồn gốc giúp xác thực nhưng cần đánh giá độ tin cậy, bền vững và khả năng chống xóa hoặc thao túng.

Vì vậy watermark chỉ là một phần của AI có thể xác minh – không phải tất cả.

Môi trường thực thi tin cậy (TEE)

Cách tiếp cận khác là xác thực nơi và cách mô hình chạy.

TEE là môi trường cách ly phần cứng giúp chứng minh tính toán diễn ra trong hệ thống bảo vệ. Giải thích của Chainlink về TEE trên blockchain cho biết TEE đặc biệt phù hợp với AI vì trọng số mô hình và dữ liệu đầu vào có thể là bí mật, TEE cung cấp môi trường bảo mật cho AI có thể xác minh mà vẫn đảm bảo tính riêng tư.

Điều này rất quan trọng với mạng tính toán phi tập trung. Nếu nhà phát triển outsource suy luận cho máy bên thứ ba, họ cần đảm bảo máy chạy đúng mô hình, không rò rỉ dữ liệu, không giả mạo kết quả. TEE là một giải pháp – dù không hoàn hảo – vì cung cấp xác thực về môi trường chạy.

Bằng chứng mật mã cho suy luận

Cách tiếp cận mạnh hơn nhưng khó hơn là chứng minh bản thân phép tính AI.

Đây là nơi machine learning không kiến thức, suy luận có thể xác minh và các hệ thống dựa trên bằng chứng xuất hiện. Một khảo sát năm 2025 về machine learning có thể xác minh dựa trên ZKP đề cập đến lĩnh vực nghiên cứu rộng nhằm xác minh quá trình huấn luyện, suy luận hoặc kiểm thử mà không tiết lộ thông tin nhạy cảm. Gần đây, bài báo tháng 3/2026 đề xuất bằng chứng mật mã nhẹ cho suy luận nhằm giảm tải hệ thống chứng minh truyền thống vốn nặng cho mô hình lớn.

Điều này quan trọng vì mục tiêu lớn nhất của AI có thể xác minh không chỉ là "hãy tin vào hộp đen này" mà là "đây là bằng chứng mật mã cho phép tính đã thực hiện đúng". Tuy nhiên, thực tế vẫn khó cho mô hình lớn do chi phí tính toán. Nhưng hướng nghiên cứu đã rõ: làm cho suy luận AI có thể chứng minh mà không chậm khó sử dụng.

Ví dụ về trường hợp sử dụng (nguồn)

Ý nghĩa AI có thể xác minh trong tiền điện tử

Ở phần mềm truyền thống, niềm tin thường dựa vào danh tiếng, hợp đồng, giám sát tập trung. Trong tiền điện tử, yêu cầu khác: người dùng muốn hệ thống mở, khả năng lắp ghép, kiểm toán độc lập.

Điều này tạo ra mâu thuẫn. AI ngày càng hữu dụng cho giao dịch, tự động hóa, tuân thủ, dự đoán nhưng đầu ra của mô hình hộp đen khó hòa hợp với hạ tầng tối thiểu hóa niềm tin. Bài viết gần đây của Chainlink về AI orchestration và verifiable AI stack cho rằng đây là nơi mạng oracle phi tập trung, báo cáo dựa trên đồng thuận và tính toán có thể xác minh phát huy vai trò. Đầu vào được lấy và xử lý qua hạ tầng phi tập trung, rồi báo cáo lại onchain, giảm phụ thuộc vào một nhà vận hành duy nhất.

Điều này đặc biệt liên quan tới:

Oracle AI cho thị trường dự đoán, bảo hiểm hoặc giao thức dựa trên sự kiện

AI agent giao dịch tự động đòi hỏi dữ liệu tin cậy và hành động kiểm toán được

Quy trình tuân thủ nơi tổ chức cần chứng minh thực thi chính sách

Ứng dụng tiêu dùng onchain muốn khai thác AI mà không tập trung hóa niềm tin

Nói đơn giản, AI có thể xác minh là yếu tố khiến “AI trên blockchain” không chỉ là khẩu hiệu tiếp thị.

Ví dụ về AI có thể xác minh trên thị trường

Chainlink: The Verifiable AI Stack

Chainlink là một trong những đơn vị đầu tiên định hình AI có thể xác minh là một ngăn xếp kết hợp AI, bằng chứng mật mã và hạ tầng blockchain. Tài liệu mới nhất kết nối trực tiếp với smart contract, TEE, AI agent orchestration, smart contract tổ chức và tính toán ngoài chuỗi có thể xác minh.

Điều quan trọng không chỉ là "Chainlink đang làm AI" mà là họ xây dựng khung giúp đầu ra AI đủ tin cậy cho ứng dụng onchain.

Lagrange: AI có thể xác minh dựa trên ZK

Tài liệu chính thức của Lagrange nhấn mạnh dự án xoay quanh công nghệ có thể xác minh và sản phẩm DeepProve hướng tới AI có thể xác minh. Nhóm dự án nhận định: “Tương lai của AI là ZK.” Điều này đặt Lagrange vào nhóm tin rằng hệ thống bằng chứng không kiến thức sẽ là hạ tầng cốt lõi cho AI đáng tin cậy.

0G: Hạ tầng AI phi tập trung

Tài liệu của 0G rộng hơn so với chỉ xác minh, nhưng hệ sinh thái của họ gắn chặt với hạ tầng AI phi tập trung, gồm suy luận phi tập trung, lưu trữ và tính sẵn có dữ liệu. Trong các tài liệu công khai, 0G cũng nhấn mạnh “AI có thể xác minh” như một phần cốt lõi của hạ tầng. Tài liệu mô tả cách nhà phát triển truy cập dịch vụ suy luận và hệ thống xử lý tính sẵn có dữ liệu, xác thực qua các node chuyên biệt.

Các ví dụ trên cho thấy AI có thể xác minh không chỉ là khái niệm học thuật mà đang trở thành sản phẩm và hạ tầng thực tế trên thị trường tiền điện tử.

AI có thể xác minh hoạt động thế nào trong thực tế

Hãy hình dung AI có thể xác minh như một chuỗi bằng chứng.

Ví dụ một sản phẩm bảo hiểm onchain do AI vận hành:

Người dùng gửi yêu cầu bồi thường kèm hình ảnh, tài liệu.

Mô hình phân tích yêu cầu ngoài chuỗi.

Hệ thống ghi nhận nguồn gốc cho phương tiện gửi lên và tạo mới.

Mô hình chạy trong TEE hoặc môi trường được xác thực khác.

Mạng phi tập trung xác minh đầu vào hoặc tổng hợp đầu ra mô hình.

Kết quả được ký, ghi lại và báo cáo onchain.

Smart contract chỉ kích hoạt nếu kiểm tra bằng chứng đạt yêu cầu.

Các hệ thống khác nhau sẽ hiện thực các phần khác nhau trong chuỗi này, nhưng mục tiêu chung là: mỗi bước quan trọng khó bị làm giả, dễ kiểm tra. Tài liệu mới của Chainlink về smart contract tổ chức và AI orchestration mô tả rõ kiến trúc kiểu này, còn C2PA và watermarking xử lý khía cạnh nguồn gốc và phương tiện.

Vai trò dữ liệu trong AI có thể xác minh (nguồn)

Lợi ích của AI có thể xác minh

Lợi ích lớn nhất là tăng niềm tin. Tuy nhiên, điều này bao gồm nhiều giá trị cụ thể hơn.

Thứ nhất, AI có thể xác minh tăng khả năng kiểm toán. Thay vì yêu cầu người dùng tin vào đơn vị cung cấp mô hình, hệ thống có thể cung cấp thông tin như credential, chữ ký, xác thực hoặc bằng chứng.

Thứ hai, hỗ trợ tuân thủ tốt hơn. Tài liệu mới của Chainlink về AI tuân thủ và smart contract tổ chức cho thấy vì sao tài chính tuân thủ quan tâm: thực thi chính sách, báo cáo và kiểm toán dễ dàng hơn khi hạ tầng được thiết kế để chứng minh những gì đã diễn ra.

Thứ ba, tăng khả năng chống giả mạo. Hệ thống nguồn gốc và watermarking không ngăn được tất cả deepfake hoặc thông tin sai, nhưng giúp nhận diện thao túng dễ hơn và xác thực mạnh hơn.

Thứ tư, cải thiện khả năng lắp ghép cho Web3. Smart contract, agent và giao thức có thể dùng AI an toàn hơn khi kiểm tra bằng chứng đi kèm đầu ra thay vì tin mù quáng.

Hạn chế và rủi ro

AI có thể xác minh rất tiềm năng nhưng không phải vạn năng.

Hạn chế lớn là mỗi phương pháp xác minh khía cạnh khác nhau. Watermark chỉ xác nhận phương tiện do AI tạo, không chứng minh nội dung bên trong đúng. Dữ liệu nguồn gốc cho biết lịch sử chỉnh sửa nhưng không xác nhận nội dung chính xác. TEE xác thực môi trường nhưng không phải mọi thuộc tính người dùng quan tâm. Hệ thống bằng chứng cho suy luận vẫn tốn tài nguyên với mô hình quy mô lớn.

Thách thức khác là phân mảnh tiêu chuẩn. C2PA quan trọng cho nguồn gốc nhưng không phải câu trả lời chung cho thực thi AI. Hệ thống ZK đang tiến bộ nhưng chưa phải lớp thực thi phổ quát cho mọi ứng dụng AI. TEE thực tế nhưng mang giả định niềm tin riêng về phần cứng và xác thực.

Ngoài ra còn cân đối chi phí, hiệu năng. Xác minh mạnh thì càng nhiều chi phí. Đó là lý do nghiên cứu tiếp tục tìm giải pháp kết hợp/hybrid, nhẹ hơn thay vì mặc định mọi phép suy luận đều được chứng minh đầy đủ. Cuối cùng, còn rủi ro thị trường: dự án có thể dùng "AI có thể xác minh" làm nhãn tiếp thị dù đảm bảo xác minh thực tế hạn chế.

Kết luận

AI có thể xác minh là một trong những ý tưởng quan trọng nhất nổi lên từ giao thoa AI và tiền điện tử, vì nó giải quyết điểm yếu cốt lõi của AI hiện đại: sự không minh bạch.

Khi AI ngày càng tích hợp sâu vào ứng dụng tài chính, agent onchain, hệ thống truyền thông, quy trình tuân thủ và phần mềm tự động hóa, người dùng ngày càng cần nhiều hơn kết quả mô hình — họ cần bằng chứng, nguồn gốc, xác thực và kiểm toán. Đó là giá trị cốt lõi của AI có thể xác minh.

Lĩnh vực này vẫn đang sớm phát triển tính đến tháng 4/2026, chưa có kiến trúc chung, mà là một chuỗi: tiêu chuẩn nguồn gốc như C2PA, công cụ watermark như SynthID, môi trường runtime tin cậy như TEE, hệ thống bằng chứng cho suy luận và thanh toán onchain. Dự án và nhà cung cấp hạ tầng như Chainlink, Lagrange, 0G đang thúc đẩy từng phần trong chuỗi này.

Có thể hiểu đơn giản: AI có thể xác minh biến AI thành thứ bạn có thể kiểm chứng và tin tưởng bằng bằng chứng — chứ không chỉ sử dụng mù quáng. Nếu xu hướng này tiếp diễn, nó có thể là ý tưởng nền tảng cho thế hệ ứng dụng Tiền điện tử tích hợp AI tiếp theo.

Khi AI và blockchain tiếp tục hội tụ, các chủ đề như AI có thể xác minh sẽ ngày càng quan trọng với cả nhà giao dịch lẫn nhà phát triển. Để theo dõi các lĩnh vực mới nổi như AI agent, DePIN, RWA hay hạ tầng onchain, Phemex cung cấp nền tảng bảo mật, thân thiện để theo dõi xu hướng thị trường, khám phá cơ hội và nâng cao lợi thế giao dịch.