重要なポイント

- 検証可能なAI(Verifiable AI)とは、AIの出力やモデルの挙動、コンテンツの出所について、主張だけでなく証拠を付与するという考え方です。

- 実際には、コンテンツの出所情報、ウォーターマーキング、暗号署名、Trusted Execution Environment(TEE)、および推論のためのゼロ知識証明やその他の証明システムなどが含まれます。

- 暗号資産分野においては、スマートコントラクトが不透明なオフチェーンAIの出力を信頼最小化で利用するために、検証層が不可欠です。

- 2026年4月時点では、Chainlink、Lagrange、0GなどのプロジェクトやC2PAのような出所標準、SynthIDのようなウォーターマーキングツールなど、多様なインフラと規格が発展途上です。

- 検証可能なAI分野は期待されていますが、現時点では統一された標準はなく、システムごとに検証対象が異なります。

人工知能(AI)は進化を続けていますが、その信頼性が課題となっています。

AIモデルがレポートを要約したり、取引をフラグしたり、資産価格を算定したり、オンチェーン動作をトリガーしたり、画像生成を行う際、ユーザーは通常AIシステムが主張どおりの動作をしたと信じるしかありません。しかし多くの場合、どのモデルが出力したのか、どのデータが使われたのか、出力が変更されたかどうか、モデルが承認済み環境で実行されたかなどを独自に検証できません。この信頼性ギャップこそ、検証可能なAIが解決しようとする課題です。OpenAIはAIの検証性を「AIシステムの主張に証拠を提供できる能力」と説明し、NISTはウォーターマーキングや暗号署名、デジタルフィンガープリント、モデルの完全性検証などを出所証明・信頼性確保の手法として挙げています。

概して、検証可能なAIはAIシステムをより監査可能・証明可能・改ざん検出可能にする技術です。ユースケースにより、AI生成コンテンツの出所証明、特定モデルの実行証明、入力・出力の改ざん不可証明、またはオフチェーンAI計算をオンチェーンアプリが信頼できる形で証明するなど、多様な目的があります。Chainlinkは「検証可能なAIスタック」として、AIと暗号証明、ブロックチェーン基盤を組み合わせることで、スマートコントラクトがオフチェーンAI出力を信頼できる仕組みを提供すると説明しています。

つまり、検証可能なAIは単一のプロダクトやトークンではなく、「ユーザーにAIシステムを信じてもらうだけでなく、証拠を提示する」という設計思想です。

「検証可能なAI」とは何か?

この用語は抽象的に聞こえるかもしれませんが、要は「何を検証するのか?」という問いに分解できます。

以下のような観点があります:

- 出所の検証 — この画像、動画、音声、文書はAIで作成・編集されたのか?その履歴は?C2PAのContent Credentialsはコンテンツの出所を証明し、作成・編集情報を安全に紐付ける標準です。

- 生成の検証 — このコンテンツは承認されたAIシステムで生成されたものか?Google DeepMindのSynthIDはAI生成コンテンツを特定するウォーターマーキング手法の一例です。

- 実行の検証 — モデルは主張どおりの入力・環境・手順で改ざんなく実行されたか?ここでTEEやアテステーション、証明ベース推論が活用されます。Chainlinkの資料でもこのテーマが強調されています。

- ブロックチェーン向けの計算検証 — オフチェーンAI出力に対し、スマートコントラクトは安全に動作できるのか?直接検証できないため、検証可能な計算や証明レイヤーが不可欠になります。

「検証可能なAI」と言うとき、これら複数の層を同時に指す場合もあります。そのため、本分野は幅広く、メディア認証、推論正しさ証明、オンチェーンAIエージェントの監査性など、異なるプロジェクトごとにフォーカスが異なります。

検証可能なAIが重要な理由

AIは人間が手作業で全てを検証できない場面で役立ちますが、出力が重要なほど検証の必要性は高まります。

以下のようなケースが考えられます:

- 規制金融プラットフォームでAIが怪しい取引を検出

- AIオラクルがイベント分析を予測市場に提供

- 自律型AIエージェントがオンチェーンポートフォリオをリバランス

- 市場影響の大きいニュース時に生成画像や動画が急拡散

- モデルが特定データ利用やコンプライアンス制約を遵守した証拠が必要

これらの場面では「モデルがそう言ったから」という信頼だけでは不十分です。NISTはウォーターマーキングやコンテンツ認証を出所・完全性確保の手段とするべきとし、OpenAIもAI開発の検証性向上を安全性・公正性・プライバシー担保のための証拠提供と位置付けています。

暗号資産分野では特にこの課題が鮮明です。ブロックチェーンは本来、信頼最小化設計ですが、AIはブラックボックス化しやすく監査が困難です。Chainlinkも検証可能なAIやAIエージェントのオーケストレーションによって、オフチェーン処理やモデル駆動ワークフローをオンチェーンに透明・監査・ポリシー準拠で戻す必要性を指摘しています。

このように、検証可能なAIはAIと暗号資産を繋ぐ重要テーマの一つとなりつつあります。

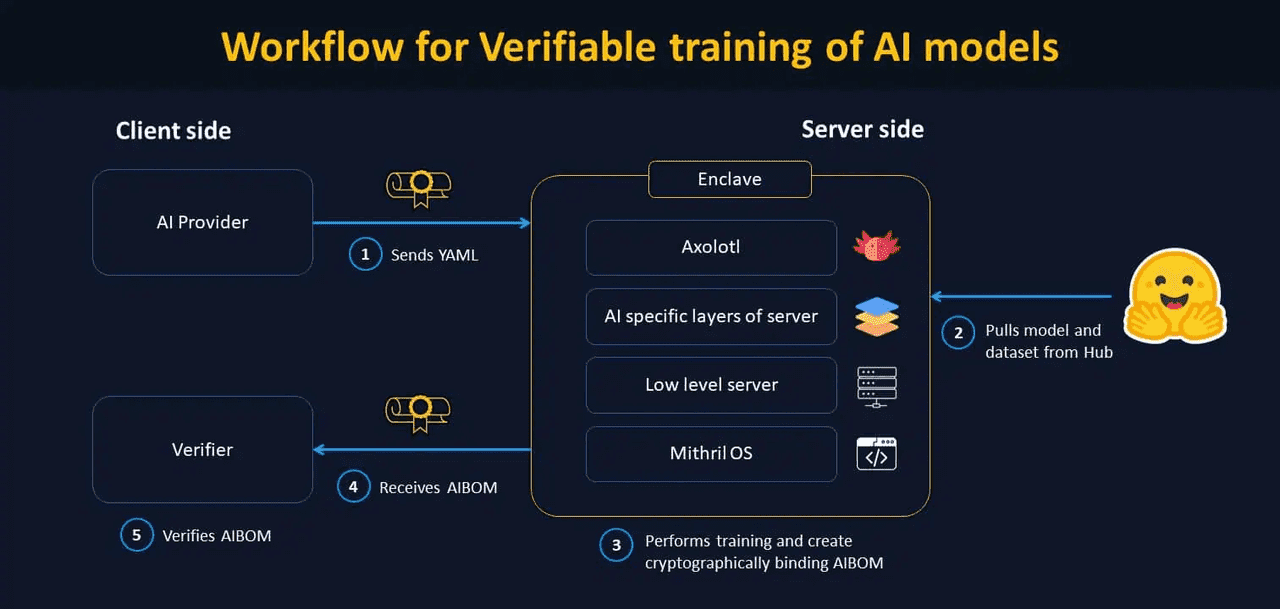

AIトレーニングの検証可能なワークフロー(出典)

検証可能なAIの主要構成要素

-

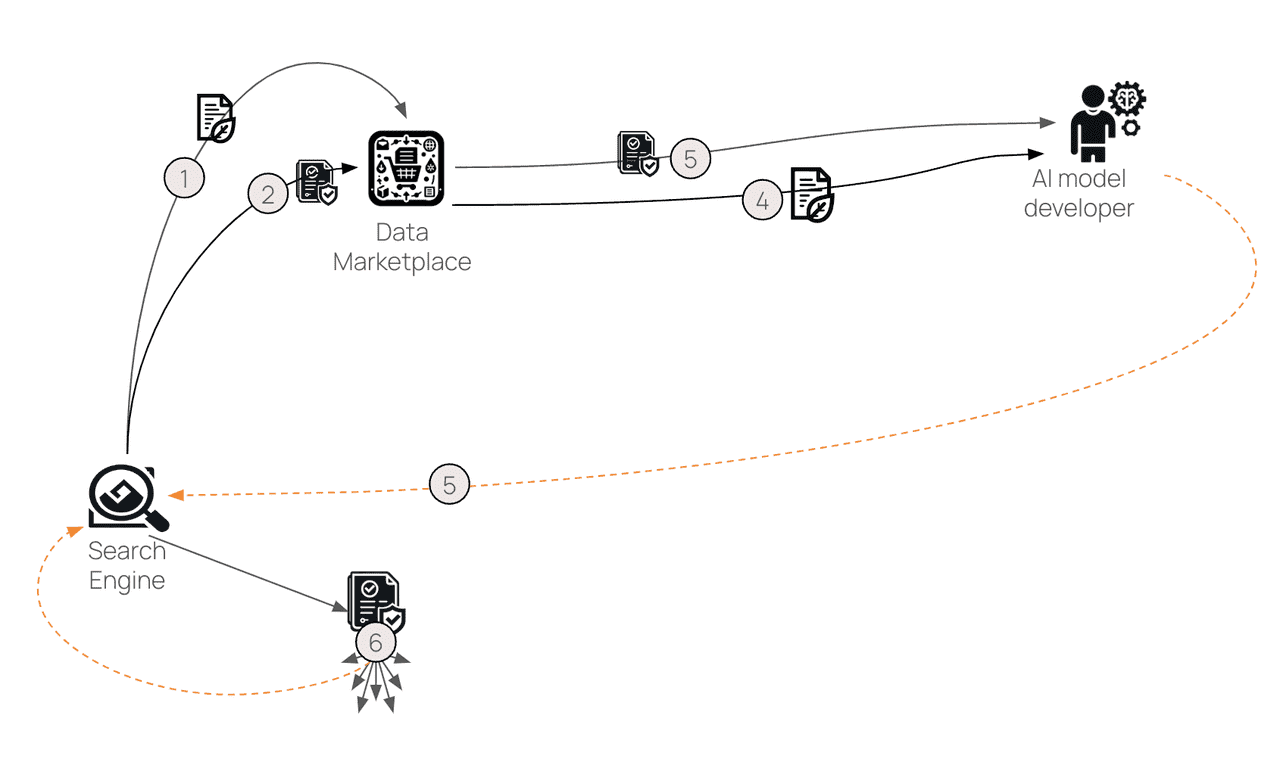

出所情報とContent Credentials

最もシンプルな検証可能AIの形は、コンテンツの出所証明です。

C2PAフレームワークは代表的な標準の1つで、Content Credentialsによりコンテンツの出所を証明し、その情報をメディアへ安全に紐付けます。ウェブサイトでは「デジタルコンテンツの栄養成分表示」に例えられ、履歴の可視化が強調されています。

これはコンテンツの「真実性」を保証するものではありませんが、以下のような疑問解消に役立ちます:

- 誰が作成したか?

- AIが関与したか?

- 編集されたか?

- どのソフトウェアが使用されたか?

- 出所データは保持されているか?

これは報道、ブランド管理、法的証拠、偽造/加工メディアによる被害防止、そして暗号資産分野における偽情報対策にも不可欠です。

-

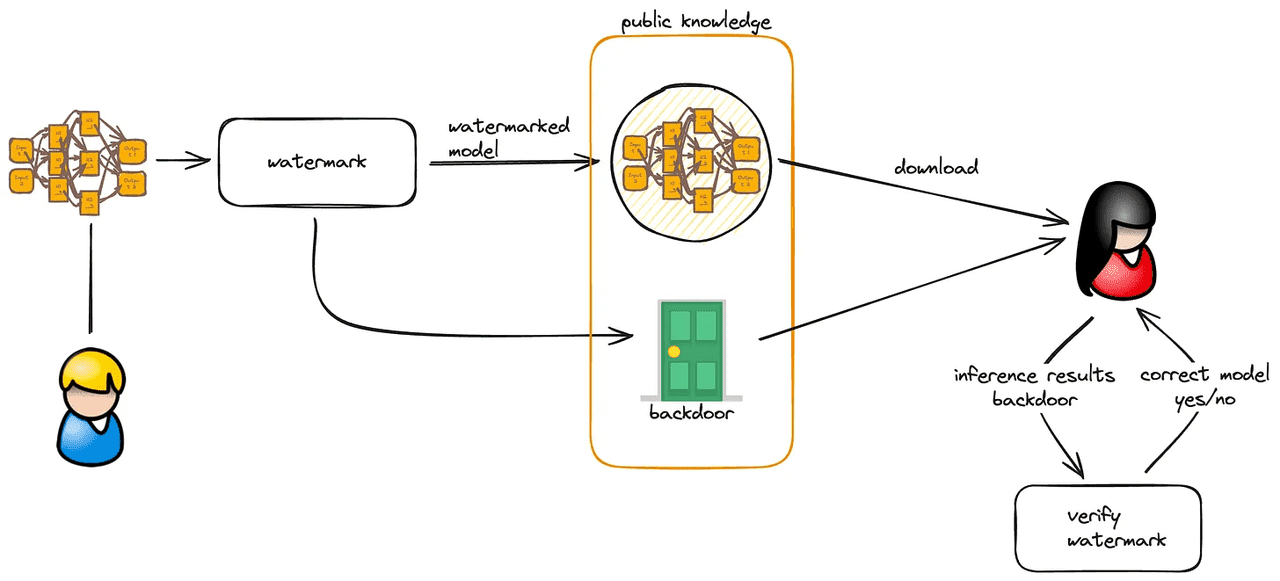

ウォーターマーキング

次のレイヤーはウォーターマーキングです。AI生成メディアに識別可能な信号を埋め込み、後から特定できるようにします。

Google DeepMindのSynthIDは明確な事例です。画像の場合、目に見えないウォーターマークをピクセルに直接埋め込む仕組みです。音声や音楽にも応用例があります。

ウォーターマーキングは有用ですが万能ではありません。NISTも、信頼性や頑健性、削除・改ざんへの耐性評価が必要と指摘しています。検証可能AIの一構成要素と捉えるのが適切です。

-

Trusted Execution Environment(TEE)

モデルの実行環境・方法の検証も重要です。

TEEはハードウェア分離による保護環境で、特定計算が安全に実行された証拠を提供します。Chainlinkの解説では、モデルの重みや入力データが機密である場合など、AIの検証安全性と秘匿性の両立に有効とされています。

分散型計算ネットワークにおいて、推論を外部マシンへ委託する場合も「正しいモデルが実行され、データ漏洩や出力捏造がない」ことへの証明が必要です。TEEは完璧ではないものの、ランタイム環境の証明(アテステーション)を提供します。

-

推論の暗号証明

より強力だが難易度も高いのが、AI計算自体の証明です。

ゼロ知識機械学習、検証可能推論、証明ベースシステムがこの領域です。2025年のZKPベースの検証可能機械学習サーベイでは、トレーニングや推論・テストを機密情報を開示せず検証する研究が進んでいるとされています。2026年3月には、大規模モデル向けに計算負荷を抑えた軽量暗号証明も提案されました。

究極の目標は「安全な箱を信じる」のではなく「計算が正しく行われたことを暗号的に証明する」ことです。現状、巨大モデルでは負荷が高いですが、推論の証明を現実的な速度で可能にする方向性で研究が進んでいます。

ユースケース例(出典)

暗号資産分野における検証可能なAIの意味

従来のソフトウェアでは、信頼は評判や契約、中央集権的な監督に依存しますが、暗号資産分野では公開性・組み合わせ・独立監査が必須です。

AIは取引・自動化・コンプライアンス・予測で有益ですが、ブラックボックスモデルの出力は信頼最小化の基盤と相容れません。ChainlinkのAIオーケストレーションや検証可能AIスタック解説では、「分散型オラクルネットワーク・合意ベースのレポーティング・検証可能計算」がこのギャップを埋めるとされています。分散ネットワーク上で入力を取得・処理し、オンチェーンに報告することで単一運用者への依存を最小化します。

特に以下に有用です:

- 予測市場・保険・イベント駆動型プロトコル向けAIオラクル

- 信頼されたデータと監査可能な行動が必要な自律型トレーディングエージェント

- ポリシー遵守証拠が求められるコンプライアンスワークフロー

- 完全な中央集権化を避けつつAIを活用したいオンチェーン消費者向けアプリ

端的に言えば、検証可能なAIによって「ブロックチェーン上のAI」は単なる宣伝文句ではなくなります。

市場における検証可能AIの事例

Chainlink:検証可能AIスタック

ChainlinkはAI・暗号証明・ブロックチェーン基盤を組み合わせた「検証可能AIスタック」概念を提唱しています。近年の資料ではスマートコントラクト、TEE、エージェントオーケストレーション、機関投資家向けスマートコントラクト、検証可能なオフチェーン計算などとの直接的な関連が示されています。

Academy読者にとって重要なのは「ChainlinkがAIに取り組んでいる」ことそのものではなく、AI出力をオンチェーン利用に十分信頼できるフレームワークを明確に示している点です。

Lagrange:ZKによる検証可能AI

Lagrangeの公式ドキュメントでは、検証可能技術を軸にDeepProveを検証可能AI向け製品と位置付けています。「AIの未来はZK(ゼロ知識証明)」という言葉通り、この分野でZK証明が中核インフラになると考えています。

0G:分散型AIインフラ

0Gは検証性だけでなく、分散型AIインフラ全体(分散推論、ストレージ、データ可用性)をカバーします。公開資料でも「検証可能なAI」という観点が強調され、開発者が推論サービスやデータ検証ノードを活用できる仕組みが整えられています。

これらの例から、検証可能なAIは単なる学術用語ではなく、実際のプロダクトやインフラストーリーとして市場で展開されていることが分かります。

検証可能なAIの実践例

検証可能なAIは「証拠の連鎖」として捉えると分かりやすいでしょう。

例えば、オンチェーンAI保険プロダクトの場合:

- ユーザーが画像や文書とともに請求を提出

- モデルがオフチェーンで請求を分析

- 提出・生成メディアの出所情報を記録

- モデルがTEEなどのアテステッド環境で実行

- 分散ネットワークが入力や出力の集約・検証を行う

- 結果が署名・記録されオンチェーンで報告

- 必要な証拠チェックを通った場合のみスマートコントラクトが動作

システムごとに実装範囲は異なりますが、全ての重要ステップを監査可能・改ざん困難にする思想は共通です。Chainlinkの最新資料やC2PA/ウォーターマーキング標準がこのアーキテクチャと密接に関連しています。

検証可能なAIにおけるデータの役割(出典)

検証可能なAIのメリット

最大のメリットは「信頼性向上」ですが、具体的には以下の利点があります。

第一に、監査容易性が向上します。モデル提供者の主張ではなく、クレデンシャルや署名、証明などの証拠を提示できます。

第二に、コンプライアンス対応力の強化です。Chainlinkの資料では、ポリシー執行・レポーティング・監査履歴の証明が金融機関にとって重要であることが強調されています。

第三に、不正や改ざんへの耐性向上です。出所管理やウォーターマーキングはフェイクや偽情報の根絶には至らないものの、改ざん検出や信頼性シグナルの強化に寄与します。

第四に、Web3エコシステムにおける構成可能性の拡大です。スマートコントラクトやエージェント、プロトコルがAI出力の証拠を検証することで、より安全にAIを活用できます。

限界とリスク

検証可能なAIは期待されていますが、万能ではありません。

主要な課題は、手法ごとに検証範囲が異なることです。ウォーターマークはAI生成メディアを示しますが、メディア内容の真偽は保証できません。出所記録は編集履歴を示しますが、内容や精度までは担保しません。TEEは環境証明を行いますが、全てのプロパティをカバーできるとは限りません。証明付き推論は大規模モデルでは依然として負荷が高い課題があります。

また、標準の分断も課題です。C2PAは出所証明では重要ですが、AI実行の包括的標準ではありません。ZKシステムも進展中ですが、全AIアプリケーション共通のランタイムには至っていません。TEEは実用的ですが、ハードウェアや証明への信頼前提を伴います。

検証を厳格化するとコストやパフォーマンスのトレードオフも生じます。現状、軽量な証明システムやハイブリッド型の研究が進められています。さらに、暗号資産分野では「検証可能AI」を謳いながらも、実際の検証保証が限定的なプロジェクトも存在するリスクがあります。

まとめ

検証可能なAIは、AIと暗号資産の融合によって生まれた最も重要な概念の一つです。なぜなら、現代AIシステムの最大の弱点である「不透明性」に取り組むからです。

AIが金融アプリ、オンチェーンエージェント、メディア、コンプライアンスワークフロー、自律ソフトウェアに組み込まれる中、ユーザーは単なるAIの出力以上のもの——証明、出所、証明書、監査履歴——を必要とするようになります。これこそが検証可能なAIの本質的な価値です。

この分野は2026年4月時点では発展途上で、普遍的なアーキテクチャはまだありませんが、C2PAなどの出所標準、SynthIDなどのウォーターマーキング、TEEによる信頼ランタイム、推論・オンチェーン決済向けの先端証明システムといったレイヤーごとに発展中です。Chainlink、Lagrange、0Gなどのプロジェクトやインフラもそれぞれ異なるパートを推進しています。

まとめると、検証可能なAIは「使うだけのAI」から「証拠をもって検証可能なAI」へと進化する取り組みです。この流れが続けば、次世代のAI活用型暗号資産アプリの基盤的な概念になり得ます。

AIとブロックチェーンの融合が進む中、検証可能なAIのようなストーリーは、トレーダーと開発者の双方にとってより重要になるでしょう。AIエージェントやDePIN、RWA、オンチェーンインフラなど新興分野を先取りしたい方は、Phemexが市場動向の追跡や新たな可能性の探索、取引スキル向上をサポートします。