Puntos clave

La IA verificable propone que las salidas de la IA, el comportamiento de los modelos o la procedencia del contenido vayan acompañados de pruebas, no solo afirmaciones.

En la práctica, la IA verificable puede incluir: procedencia de contenido, marcas de agua, firmas criptográficas, entornos de ejecución confiables (TEEs) y pruebas como zero-knowledge proof u otros sistemas para la inferencia.

El concepto cobra especial relevancia en el sector cripto porque los smart contracts no pueden depender de resultados de IA opacos fuera de la cadena sin una capa de verificación que minimice la confianza.

Hasta abril de 2026, este campo incluye nuevas infraestructuras de proyectos y protocolos como Chainlink, Lagrange y 0G, junto a estándares de procedencia como C2PA Content Credentials o herramientas de marcas de agua como SynthID.

La IA verificable es prometedora, pero aún está en una fase inicial. No existe un estándar universal y los distintos sistemas verifican aspectos diferentes.

La inteligencia artificial avanza en capacidades, pero su confianza es cada vez más difícil de asegurar.

Cuando un modelo de IA resume un informe, señala una transacción, valora un activo, activa una acción en la cadena o genera una imagen, normalmente el usuario debe confiar en que el sistema hizo lo que afirma. Muchas veces no puede verificar de forma independiente qué modelo generó ese resultado, qué datos se usaron, si se alteró la salida o si el modelo funcionó en un entorno aprobado. Esa brecha de confianza es lo que la IA verificable busca resolver. OpenAI define la verificabilidad en la IA como la capacidad de aportar pruebas sobre el funcionamiento del sistema, mientras que NIST destaca técnicas como el watermarking, firmas criptográficas y verificación de integridad del modelo para respaldar la procedencia y la confianza.

En general, la IA verificable se refiere a métodos que hacen los sistemas de IA más auditables, demostrables y resistentes a manipulaciones. Dependiendo del caso de uso, puede significar probar la procedencia del contenido generado, certificar que un modelo concreto se ha ejecutado como se afirma, demostrar que las entradas y salidas no fueron alteradas o dar garantías a una aplicación onchain sobre la fiabilidad de una inferencia realizada fuera de la cadena. La reciente descripción de Chainlink sobre el "stack de IA verificable" recoge bien la idea: combina IA con pruebas criptográficas y blockchain, para que los smart contracts puedan usar salidas de IA con garantías de integridad respecto a la ejecución fuera de la cadena.

En otras palabras, la IA verificable no es un producto ni un token concreto. Es una filosofía de diseño más amplia: no pedir solo confianza, sino aportar evidencias.

¿Qué significa realmente "IA verificable"?

El término puede sonar abstracto, así que conviene simplificarlo:

¿Qué estamos verificando exactamente?

Puede referirse a varios aspectos:

Verificar la procedencia — ¿Esta imagen, vídeo, audio o documento fue creado o editado por IA? ¿Cuál es su historial? El estándar Content Credentials de C2PA está basado en esa idea, describiendo las credenciales como una forma de establecer la procedencia y adjuntar información segura sobre cómo se generó o modificó el contenido.

Verificar la generación — ¿Este contenido lo produjo un sistema de IA autorizado? SynthID de Google DeepMind es un ejemplo de marca de agua que identifica contenido generado o alterado por IA.

Verificar la ejecución — ¿El modelo de IA se ejecutó realmente como se afirma, con las entradas y entorno previstos y sin manipulaciones? Aquí juegan un papel importante los TEEs, sistemas de atestación y pruebas de inferencia. Los materiales educativos de Chainlink, así como su análisis sobre IA verificable, relacionan este reto con la ejecución segura y el cómputo confiable.

Verificar el cómputo para blockchains — ¿Puede un smart contract actuar de forma segura sobre una salida de IA realizada fuera de la cadena? Como las blockchains no pueden ver directamente inferencias externas, las capas de verificación y pruebas son esenciales si la IA debe activar acciones valiosas onchain.

Por ello, cuando se habla de "IA verificable", puede referirse a una o varias de estas capas a la vez. De ahí su amplitud: un equipo puede centrarse en autenticar medios, otro en demostrar la corrección de la inferencia y otro en auditar agentes de IA en workflows onchain.

Por qué importa la IA verificable

La utilidad de la IA está en que puede operar donde los humanos no pueden comprobarlo todo manualmente. Pero eso plantea un problema: cuanto más crítico el resultado, más importante la verificación.

Ejemplos:

- Un modelo de IA señala transacciones sospechosas en una plataforma financiera regulada.

- Un oráculo de IA proporciona análisis de eventos a un mercado de predicción.

- Un agente autónomo de IA reajusta una cartera onchain.

- Una imagen o vídeo generado se vuelve viral durante una noticia relevante para el mercado.

- Una empresa requiere pruebas de que el modelo cumplió ciertas restricciones de uso de datos o normativas.

En todos esos casos, la confianza no puede basarse solo en "el modelo lo dice". Las recomendaciones de NIST sobre riesgos de contenido sintético destacan el watermarking y la autenticación de contenido como herramientas para procedencia e integridad, mientras que OpenAI subraya la verificabilidad como medio para aportar pruebas de seguridad, equidad o privacidad en sistemas de IA.

En cripto, el problema es aún más acuciante. Las blockchains están diseñadas para minimizar la confianza, pero los sistemas de IA suelen ser opacos, fuera de la cadena y difíciles de auditar. Es un choque natural. Chainlink lo expone claramente: IA verificable y la orquestación de agentes de IA son necesarias para que los procesos y modelos externos puedan reportarse onchain con transparencia, auditabilidad y cumplimiento de políticas.

Por eso la IA verificable es uno de los subtemas clave en la convergencia de IA y cripto: busca cerrar la brecha entre sistemas inteligentes y sistemas de mínima confianza.

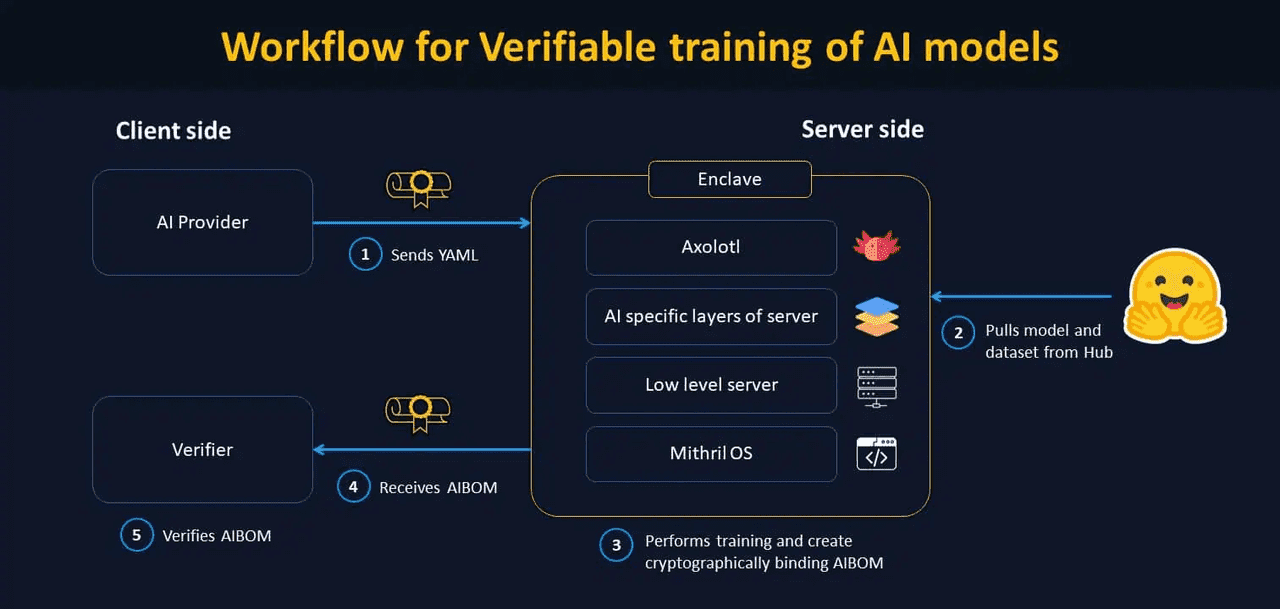

Flujo verificable para entrenar IA (fuente)

Principales componentes de la IA verificable

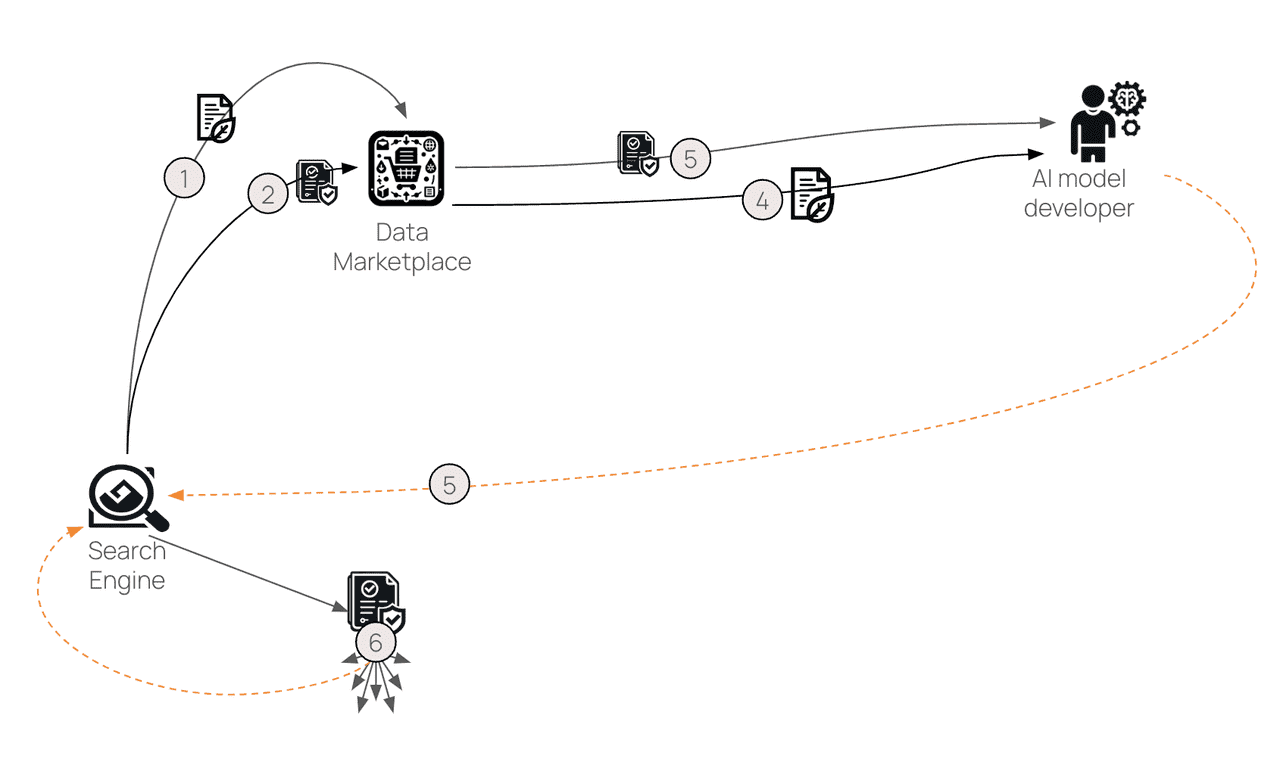

Procedencia y credenciales de contenido

Una de las formas más simples de IA verificable es demostrar de dónde proviene el contenido.

El marco C2PA es uno de los estándares principales. Explica que Content Credentials permiten establecer la procedencia y asociar declaraciones seguras al contenido. Se compara con una "etiqueta nutricional" para contenido digital que permite inspeccionar su historial.

Esto no garantiza que el contenido sea "verdadero", pero ayuda a responder preguntas como:

- ¿Quién lo creó?

- ¿Hubo intervención de IA?

- ¿Se editó?

- ¿Qué software se utilizó?

- ¿La información de procedencia se conserva?

Esto es relevante en periodismo, marcas, pruebas legales y cualquier contexto donde contenido manipulado pueda causar daño real. También es clave en cripto, donde capturas de pantalla, documentos o desinformación generados por IA pueden influir rápidamente en los mercados.

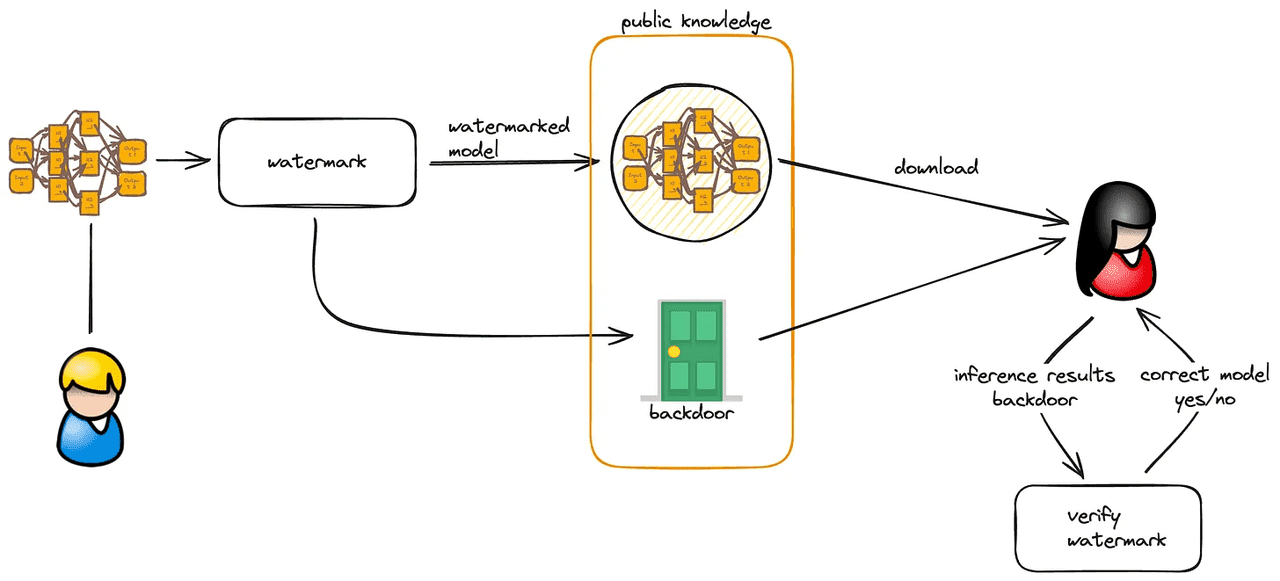

Marcas de agua

Otra capa es el watermarking: incluir señales en medios generados por IA para identificarlos después.

SynthID de Google DeepMind es un ejemplo claro. Es una herramienta para marcar e identificar contenido generado por IA, diseñada para fomentar transparencia y confianza en IA generativa. Para imágenes, incrusta una marca de agua imperceptible en los píxeles; también han descrito métodos para música y sonido.

El watermarking es útil, pero no es una solución total. NIST señala que tanto la procedencia como el watermarking ayudan a la autenticación, pero deben evaluarse en cuanto a fiabilidad, robustez y resistencia a la manipulación o eliminación.

Así que, el watermarking es solo una parte de la IA verificable, no el todo.

Entornos de ejecución confiables (TEEs)

Otra vía es verificar dónde y cómo se ejecutó el modelo.

Los TEEs son entornos aislados por hardware que permiten probar que un cálculo se realizó en un sistema protegido. Chainlink explica que son relevantes para IA porque los pesos del modelo y los datos de entrada pueden ser sensibles, y los TEEs aportan seguridad y confidencialidad.

Esto es importante en redes de cómputo descentralizadas. Si los desarrolladores externalizan la inferencia, necesitan confianza en que se ejecutó el modelo correcto, no se expusieron los datos y no se falsificó la salida. Los TEEs pueden atestiguar el entorno de ejecución, aunque no son perfectos.

Pruebas criptográficas de inferencia

Una vía más avanzada es probar el cálculo de IA en sí.

Aquí entran la IA con zero-knowledge, la inferencia verificable y los sistemas basados en pruebas. Un estudio de 2025 sobre aprendizaje automático verificable mediante ZKP describe los avances en verificar entrenamiento, inferencia o testeo sin revelar información sensible. Un artículo de marzo de 2026 propone pruebas criptográficas ligeras para reducir el coste computacional de los sistemas clásicos en modelos grandes.

Esto es relevante porque el objetivo no es solo "confía en esta caja segura", sino "aquí tienes una prueba criptográfica de que el cálculo fue correcto". En la práctica, sigue siendo complejo para modelos grandes porque las pruebas son costosas, pero la tendencia es clara: lograr inferencias demostrables sin perder usabilidad.

Ejemplo de caso de uso (fuente)

Qué significa la IA verificable en cripto

En software tradicional, la confianza suele derivar de la reputación, contratos y supervisión centralizada. En cripto, el estándar es distinto: los usuarios esperan sistemas abiertos, componibles y auditables de forma independiente.

Eso genera una tensión. La IA es cada vez más útil para trading, automatización, cumplimiento y predicción, pero la salida de un modelo opaco es difícil de conciliar con infraestructuras de mínima confianza. Los artículos recientes de Chainlink sobre orquestación de IA y stack de IA verificable proponen que aquí es donde las redes de oráculos descentralizados, reportes por consenso y cómputo verificable pueden aportar valor. Las entradas pueden obtenerse y procesarse en infraestructuras descentralizadas, y reportarse onchain minimizando la dependencia en un solo operador.

Esto es especialmente relevante para:

- Oráculos de IA para mercados de predicción, seguros o protocolos basados en eventos

- Agentes de trading autónomos que necesitan datos confiables y acciones auditables

- Workflows de cumplimiento donde las instituciones requieren pruebas de las políticas aplicadas

- Apps de consumo onchain que buscan aprovechar la IA sin centralizar totalmente la confianza

En resumen, la IA verificable convierte el concepto de "IA en blockchain" en algo más que una frase de marketing.

Ejemplos de IA verificable en el mercado

Chainlink: El stack de IA verificable

Chainlink es una de las voces que mejor enmarcan la IA verificable como una combinación de IA, pruebas criptográficas e infraestructura blockchain. Sus materiales recientes lo relacionan directamente con smart contracts, TEEs, orquestación de agentes, smart contracts institucionales y cómputo verificable offchain.

Para los lectores de Academy, lo relevante no es solo "Chainlink apuesta por la IA", sino que define un marco para que las salidas de IA sean lo suficientemente confiables para usarse onchain.

Lagrange: IA verificable basada en ZK

La documentación oficial de Lagrange posiciona el proyecto en torno a la tecnología verificable y menciona su producto DeepProve para IA verificable. El posicionamiento es claro: "El futuro de la IA es ZK". Esto sitúa a Lagrange en el grupo que considera los sistemas de pruebas de conocimiento cero como infraestructura clave para la IA confiable.

0G: Infraestructura para IA descentralizada

La documentación de 0G abarca más que la verificabilidad, pero su posicionamiento está muy vinculado a la infraestructura de IA descentralizada, incluyendo inferencia, almacenamiento y disponibilidad de datos descentralizados. En sus materiales públicos, 0G también relaciona la "IA verificable" con su propuesta de infraestructura. Sus documentos muestran cómo los desarrolladores pueden acceder a servicios de inferencia y cómo la red gestiona la disponibilidad y verificación de datos a través de nodos especializados.

Estos ejemplos demuestran que la IA verificable ya es una narrativa de producto e infraestructura activa en el mercado cripto.

Cómo podría funcionar la IA verificable en la práctica

Una forma útil de entender la IA verificable es como una cadena de evidencias.

Por ejemplo, imagina un seguro onchain habilitado por IA:

- Un usuario presenta una reclamación con imágenes y documentos.

- Un modelo analiza la reclamación fuera de la cadena.

- El sistema registra la procedencia de los medios recibidos y generados.

- El modelo se ejecuta en un TEE u otro entorno atestiguado.

- Una red descentralizada verifica las entradas o agrega las salidas del modelo.

- El resultado se firma, registra y reporta onchain.

- El smart contract solo actúa si se cumplen las comprobaciones requeridas.

Distintos sistemas cubrirán distintas partes de este stack, pero la idea es la misma: hacer cada paso crítico más auditable y difícil de falsear. Los materiales recientes de Chainlink sobre smart contracts institucionales y orquestación de IA se alinean con esta arquitectura; los sistemas tipo C2PA y watermarking abordan la parte de medios y procedencia.

Rol de los datos en la IA verificable (fuente)

Beneficios de la IA verificable

El principal beneficio es evidente: mayor confianza. Pero esa confianza se traduce en varias ventajas específicas.

Primero, la IA verificable mejora la auditabilidad. En vez de pedir confianza ciega al proveedor de modelos, el sistema puede aportar credenciales, firmas, atestaciones o pruebas.

Segundo, puede facilitar el cumplimiento normativo. Los materiales recientes de Chainlink sobre IA para cumplimiento y smart contracts institucionales muestran por qué la industria financiera regulada está interesada: la aplicación de políticas, reportes y auditorías se simplifican si la infraestructura puede demostrar qué ha ocurrido.

Tercero, mejora la resiliencia ante manipulaciones. Los sistemas de procedencia y watermarking no impedirán todos los deepfakes o la desinformación, pero sí hacen más detectable la manipulación y ofrecen señales de autenticidad.

Cuarto, impulsa la composabilidad en Web3. Los smart contracts, agentes y protocolos pueden usar la IA con más seguridad si pueden inspeccionar las evidencias asociadas a una salida, en vez de confiar a ciegas.

Limitaciones y riesgos

La IA verificable es prometedora, pero no es una solución mágica.

Una limitación es que los distintos métodos verifican aspectos diferentes. Una marca de agua puede indicar que un medio fue generado por IA, pero no prueba la veracidad del contenido. Un registro de procedencia muestra el historial de edición, pero no garantiza la exactitud. Un TEE acredita el entorno, pero no todo lo que importa al usuario. Y los sistemas de pruebas para inferencia siguen siendo costosos para modelos a gran escala.

Otro reto es la fragmentación de estándares. C2PA es clave para la procedencia, pero no resuelve la ejecución de IA. Los sistemas ZK avanzan, pero aún no son la capa universal para todas las aplicaciones de IA. Los TEEs son prácticos, pero introducen sus propias suposiciones de confianza.

También existe una contrapartida en coste y rendimiento: más verificación suele implicar más sobrecarga. Por eso la investigación actual explora sistemas de pruebas más ligeros y enfoques híbridos, en vez de asumir que toda inferencia será demostrable a bajo coste. Finalmente, existe un riesgo de mercado: algunos proyectos pueden usar "IA verificable" como etiqueta narrativa sin que su verificación sea amplia.

Conclusión

La IA verificable es una de las ideas clave de la convergencia entre IA y cripto porque aborda una debilidad fundamental de la IA moderna: la opacidad.

A medida que la IA se integra más en apps financieras, agentes onchain, sistemas de medios, workflows de cumplimiento y software autónomo, los usuarios necesitarán algo más que resultados de modelos: requerirán pruebas, procedencia, atestaciones y trazabilidad. Ese es el verdadero potencial de la IA verificable.

La categoría sigue en fase temprana en abril de 2026 y aún no existe una arquitectura universal. Se está formando como un stack: estándares de procedencia como C2PA, herramientas de watermarking como SynthID, métodos de ejecución confiables como TEEs y sistemas de pruebas para inferencia y liquidación onchain. Proyectos como Chainlink, Lagrange y 0G impulsan partes distintas de ese stack.

La forma más sencilla de entenderlo es así: la IA verificable busca que la IA pase de ser algo que solo usas a algo que puedes inspeccionar y verificar con pruebas. Si esa tendencia continúa, podría ser una idea fundamental para la próxima generación de aplicaciones cripto potenciadas por IA.

A medida que IA y blockchain convergen, narrativas como la IA verificable serán cada vez más relevantes para traders y desarrolladores. Para quienes buscan adelantarse en sectores como agentes de IA, DePIN, RWAs o infraestructura onchain, Phemex ofrece una plataforma segura y fácil de usar para seguir tendencias, explorar oportunidades y mejorar tu experiencia de trading.