Основные выводы

Верифицируемый ИИ подразумевает, что выводы ИИ, поведение моделей или происхождение контента должны подтверждаться доказательствами, а не только заявлениями.

На практике верифицируемый ИИ включает подтверждение происхождения контента, водяные знаки, криптографические подписи, доверенные вычислительные среды (TEE) и системы доказательств, такие как zero-knowledge proofs, для вывода.

Это особенно важно в криптовалютах, поскольку смарт-контракты не могут безопасно полагаться на непрозрачные offchain-выводы без слоя минимизации доверия.

По состоянию на апрель 2026 года данное направление охватывает инфраструктурные решения от проектов и протоколов, таких как Chainlink, Lagrange, и 0G, а также общие стандарты происхождения (например, C2PA) и инструменты водяных знаков как SynthID.

Верифицируемый ИИ подает большие надежды, но стандартов и единой архитектуры пока нет — разные системы обеспечивают проверку разных аспектов.

Искусственный интеллект становится мощнее, но его труднее проверять и доверять ему.

Когда ИИ-модель резюмирует отчет, помечает транзакцию, оценивает актив, инициирует onchain-действие или генерирует изображение, пользователи обычно вынуждены доверять заявленному результату. Во многих случаях они не могут независимо проверить, какая модель выдала результат, какие данные использовались, были ли искажены выводы, либо работала ли модель в утверждённой среде. Этот разрыв доверия и призван закрыть верифицируемый ИИ. OpenAI описывает верифицируемость в ИИ как способность предоставить доказательства относительно заявлений о системе, а NIST выделяет такие методы, как водяные знаки, криптографические подписи, цифровые отпечатки и проверку целостности моделей — всё это способствует доверительному происхождению данных и надежным системам ИИ.

В общих чертах, верифицируемый ИИ — это подходы, делающие работу ИИ более проверяемой, подотчетной и защищённой от подмены. В зависимости от задачи это может включать доказательство происхождения контента, подтверждение, что определённая модель работала как заявлено, что входные и выходные данные не были изменены, либо что offchain-вычисления могут быть безопасно использованы onchain приложениями. Недавний обзор Chainlink “verifiable AI stack” иллюстрирует эту концепцию: ИИ сочетается с криптографическими доказательствами и блокчейн инфраструктурой, что позволяет смарт-контрактам использовать ИИ-выводы с гарантиями достоверности offchain-исполнения.

Верифицируемый ИИ — это не продукт и не конкретный токен, а философия проектирования: не просить пользователя доверять системе бездоказательно, а предоставлять им подтверждения.

Что на самом деле значит «верифицируемый ИИ»?

Термин может звучать абстрактно, поэтому удобно разбить его на несколько простых вопросов:

Что именно мы проверяем?

Это может быть следующее:

Проверка происхождения — Было ли изображение, видео, аудиофайл или документ создано/отредактировано ИИ, и какова его история? Стандарт Content Credentials от C2PA строится на этой идее, описывая Content Credentials как способ закрепить происхождение цифрового контента и безопасно связать заявления о том, как он был создан или изменён.

Проверка генерации — Был ли контент создан утвержденной ИИ-системой? SynthID от Google DeepMind — пример водяного знака для идентификации ИИ-контента.

Проверка исполнения — Действительно ли ИИ-модель работала, как заявлено, с нужными входными данными, в нужной среде и без искажения? Здесь применяются TEE, системы аттестации и доказательные механизмы вывода. Chainlink в своих материалах связано эту задачу с надёжным исполнением моделей и доверенными вычислениями.

Проверка вычислений для блокчейнов — Может ли смарт-контракт безопасно оперировать ИИ-выводами, если модель работала offchain? Поскольку блокчейны не могут напрямую проверять offchain-инференцию, верифицируемые вычисления и доказательные слои становятся необходимыми для ИИ-интеграции в onchain-процессы.

Когда кто-то говорит о «верифицируемом ИИ», обычно подразумеваются одна или несколько из этих проверок. Поэтому категория широка: одни команды фокусируются на аутентификации медиа, другие — на доказательстве правильности вывода, третьи — на аудируемости ИИ-агентов в onchain-процессах.

Почему верифицируемый ИИ важен

ИИ полезен именно потому, что может действовать там, где человек не способен всё проверить вручную. Но это создаёт проблему: чем важнее вывод, тем острее необходимость верификации.

Примеры:

- ИИ-модель выделяет подозрительные транзакции для регулируемой финансовой платформы.

- ИИ-оракул передаёт анализ событий в предсказательном рынке.

- Автономный ИИ-агент ребалансирует onchain-портфель.

- Генерируемое изображение или видео становится вирусным во время важного события.

- Бизнесу требуется доказательство соблюдения политик работы с данными.

Во всех этих случаях недостаточно опереться на «так сказала модель». Руководства NIST по снижению рисков синтетического контента выделяют водяные знаки и аутентификацию как инструменты для происхождения и целостности, а работа OpenAI по улучшению верифицируемости ИИ — как способ предоставить доказательства безопасности, справедливости или приватности системы.

В криптовалютах эта проблема особенно остра. Блокчейны минимизируют доверие, а ИИ-системы часто непрозрачны, offchain и сложны для аудита. Это создаёт диссонанс. Chainlink подчёркивает: верифицируемый ИИ и оркестрация ИИ-агентов нужны для прозрачности, аудируемости и соответствия политике при интеграции offchain-моделей с onchain-процессами.

Именно поэтому верифицируемый ИИ становится ключевым направлением на стыке ИИ и крипто.

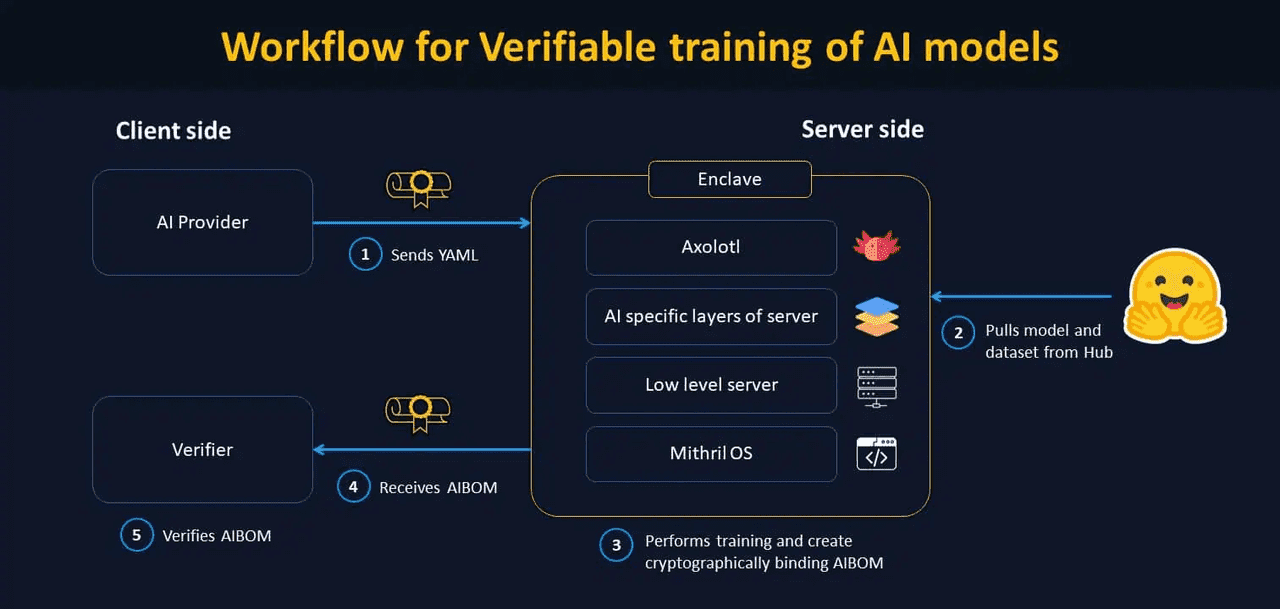

Верифицируемый процесс обучения ИИ (источник)

Основные компоненты верифицируемого ИИ

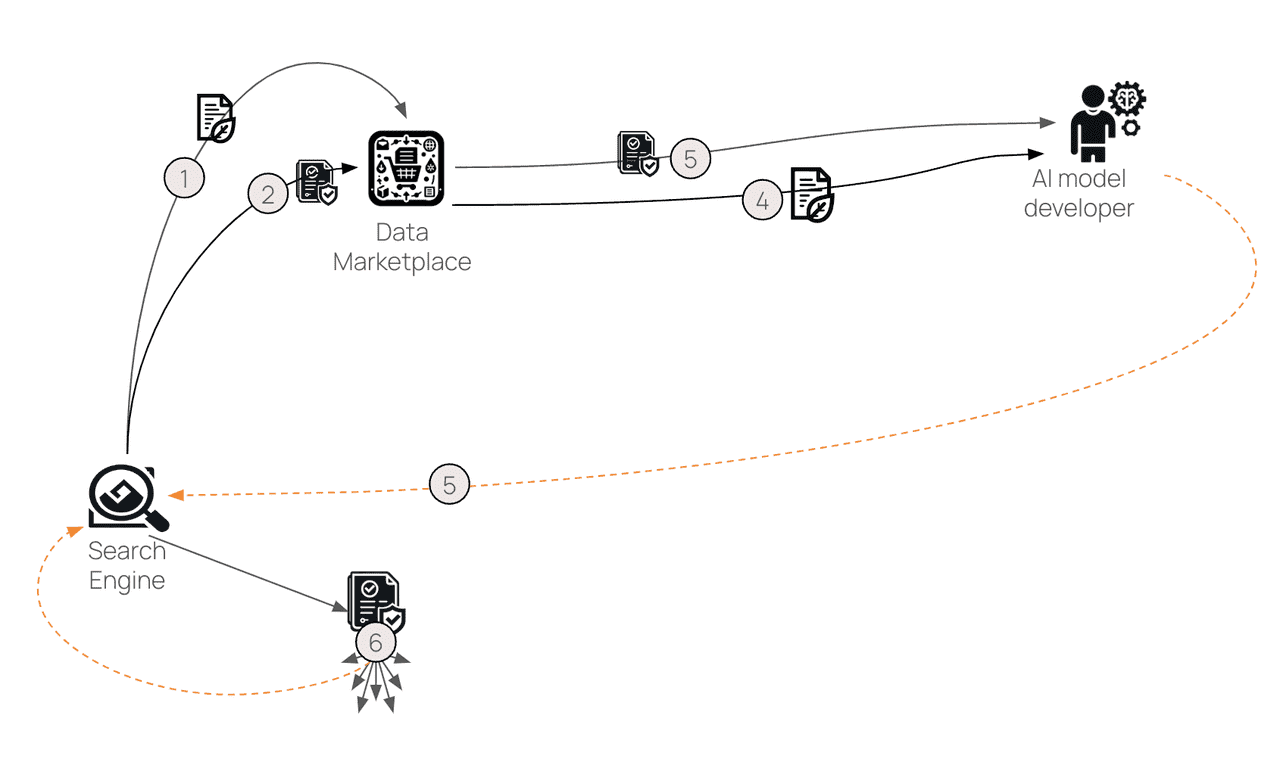

Происхождение и Content Credentials

Один из простейших способов верифицируемого ИИ — доказать происхождение контента.

Фреймворк C2PA — один из ключевых стандартов. Content Credentials — способ закрепить происхождение и историю цифрового контента. Это не гарантирует истинность, но помогает ответить на вопросы:

- Кто создал?

- Был ли задействован ИИ?

- Редактировалось ли?

- Какое ПО использовалось?

- Сохранилась ли история происхождения?

Это важно для журналистики, брендов, юридических доказательств и любых ситуаций, где подделки могут нанести ущерб. А также для криптовалют, где фальшивые скриншоты, документы и дезинформация способны влиять на рынок.

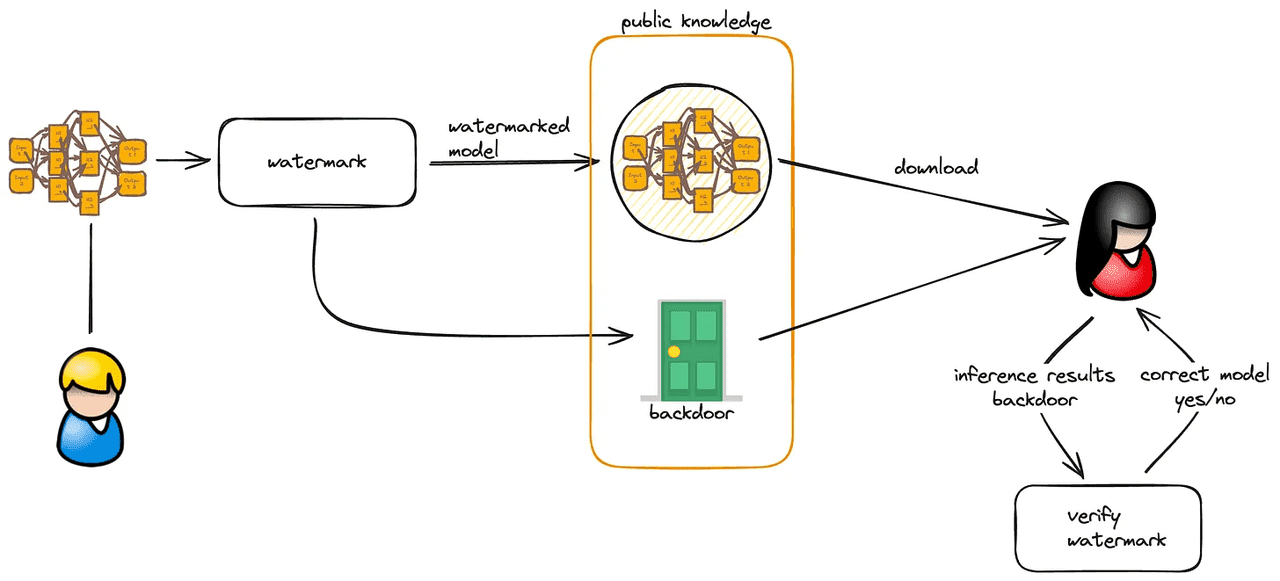

Водяные знаки

Следующий слой — водяные знаки: встраивание сигналов в ИИ-контент для последующей идентификации.

SynthID от Google DeepMind — яркий пример. Система встраивает невидимый водяной знак в пиксели изображений, а также реализованы подходы для аудио.

Водяные знаки полезны, но не панацея. Руководства NIST отмечают: происхождение и водяные знаки помогают аутентификации, но требуют оценки на устойчивость и надёжность против удаления или подделки.

Доверенные вычислительные среды (TEEs)

Ещё один подход — верификация того, где и как исполнялась модель.

TEE — аппаратно изолированная среда, позволяющая доказать, что вычисления проводились защищённо. Chainlink отмечает, что это особенно актуально для ИИ, поскольку веса моделей и входные данные могут быть конфиденциальными, а TEE обеспечивает безопасность при верификации ИИ.

Для децентрализованных вычислительных сетей это важно: разработчикам нужна уверенность, что машина исполнила правильную модель, не раскрыла данные и не сфабриковала результат. TEE дают такую аттестацию среды, несмотря на свои ограничения.

Криптографические доказательства вывода

Более сложный подход — доказательство самого ИИ-вычисления.

Здесь вступают в игру zero-knowledge машинное обучение, верифицируемый вывод, системы на доказательствах. Новые работы предлагают более «лёгкие» криптографические доказательства вывода для снижения издержек.

Это важно, поскольку конечная цель — не просто «доверять защищённой коробке», а предъявлять криптографические доказательства корректного результата. Для крупных моделей это пока сложно, но направление активно развивается.

Пример применения (источник)

Значение верифицируемого ИИ для криптоиндустрии

В традиционном ПО доверие формируется через репутацию, контракты, централизованный контроль. В крипто пользователи ожидают открытости и аудируемости.

Это создаёт вызовы. ИИ полезен для трейдинга, автоматизации, комплаенса и предсказаний, но непрозрачность «чёрных ящиков» плохо сочетается с архитектурой минимального доверия. Chainlink отмечает: децентрализованные оракулы, консенсусные отчёты и верифицируемые вычисления — решение этой задачи.

Это актуально для:

- ИИ-оракулов (предсказательные рынки, страхование, протоколы событий)

- Автономных торговых агентов, нуждающихся в проверяемых данных

- Комплаенс процессов, где нужна доказуемость соблюдения политик

- Onchain-приложений, которые хотят использовать ИИ без централизации доверия

Проще говоря, верифицируемый ИИ делает «ИИ в блокчейне» больше, чем просто модным термином.

Примеры применения верифицируемого ИИ

Chainlink: верифицируемый стек ИИ

Chainlink рассматривает верифицируемый ИИ как комбинацию ИИ, криптографических доказательств и блокчейна. Материалы описывают связь с смарт-контрактами, TEE, оркестрацией агентов, институциональными продуктами и верифицируемыми offchain-вычислениями.

Для читателей важно не просто то, что «Chainlink делает ИИ», а что формируется подход, при котором ИИ-выводы становятся пригодными для использования в onchain-процессах.

Lagrange: верифицируемый ИИ на ZK

Lagrange позиционирует DeepProve как решение для верифицируемого ИИ: «будущее ИИ — за ZK». Это ставит проект в число тех, кто считает системы zero-knowledge основой доверительных вычислений ИИ.

0G: инфраструктура для децентрализованного ИИ

0G предлагает инфраструктуру децентрализованного ИИ — включая inference, хранение и доступность данных. В публичных материалах подчеркивается вклад в развитие верифицируемого ИИ, а разработчики могут использовать сервисы inference и верификации через специальные узлы.

Эти примеры подтверждают: верифицируемый ИИ — уже не только термин из исследований, а часть рыночной инфраструктуры.

Как это работает на практике

Верифицируемый ИИ — это цепочка доказательств.

Например, в onchain-страховом продукте на базе ИИ:

- Пользователь подает заявку с изображениями и документами.

- Модель анализирует заявку offchain.

- Система фиксирует происхождение отправленных и сгенерированных данных.

- Модель работает в TEE или аттестованной среде.

- Децентрализованная сеть проверяет входные данные или агрегирует выводы модели.

- Результат подписывается, логируется и отправляется onchain.

- Смарт-контракт действует только после проверки необходимых доказательств.

Разные системы реализуют разные компоненты этого стека, но идея одна: сделать каждый ключевой шаг прозрачным и защищённым от фальсификации. Материалы Chainlink по институциональным контрактам и оркестрации ИИ-агентов соответствуют такой архитектуре, а системы C2PA и водяные знаки отвечают за происхождение медиа.

Роль данных в верифицируемом ИИ (источник)

Преимущества верифицируемого ИИ

Главное преимущество — больше доверия. Оно состоит из:

- Аудируемость: вместо «доверяйте провайдеру» система предоставляет артефакты — креденшлы, подписи, аттестации или доказательства.

- Готовность к комплаенсу: верифицируемая инфраструктура облегчает контроль политик, отчётность и аудит для регулируемых компаний.

- Устойчивость к манипуляциям: происхождение и водяные знаки не остановят все подделки, но позволят быстрее выявить вмешательство и повысить авторитетность.

- Компонуемость для Web3: смарт-контракты и агенты могут использовать ИИ, опираясь на подтверждающие доказательства.

Ограничения и риски

Верифицируемый ИИ — не панацея.

- Разные методы проверяют разные аспекты. Водяной знак говорит только о генерации ИИ, но не гарантирует истинность содержания. Запись происхождения фиксирует историю, но не точность. TEE акцентирует среду, но не все свойства. Доказательства вывода пока ресурсоёмки для крупных моделей.

- Фрагментация стандартов: C2PA важен для происхождения, но не универсален для исполнения. ZK-системы развиваются, но ещё не стали универсальным слоем для ИИ. TEE практичны, но требуют доверия к аппаратуре и аттестации.

- Проблема издержек и производительности: чем сильнее верификация, тем выше издержки. Потому исследования ищут более лёгкие подходы. В крипто есть и рыночный риск — проекты могут заявлять о «верифицируемом ИИ» при ограниченных гарантиях.

Заключение

Верифицируемый ИИ — ключевая идея на стыке ИИ и криптовалют, так как решает проблему непрозрачности современных моделей.

С развитием ИИ в финансовых приложениях, onchain-агентах, медиа, комплаенсе и автономном ПО пользователям потребуется не только результат, но и доказательства, происхождение, аттестации, аудит. В этом — главная ценность верифицируемого ИИ.

Категория ещё только формируется (апрель 2026), пока нет универсальной архитектуры. Развивается стек: стандарты происхождения (C2PA), инструменты водяных знаков (SynthID), доверенные среды (TEE), продвинутые системы доказательств для вывода и onchain-расчётов. Проекты вроде Chainlink, Lagrange, 0G двигают индустрию вперёд.

Главная идея: превратить ИИ из «чёрного ящика» в систему, чьи результаты можно инспектировать и проверять. Если эта тенденция продолжится, она станет основой нового поколения ИИ-приложений в крипто.

С объединением ИИ и блокчейна такие подходы будут особенно актуальны для трейдеров и разработчиков. Для пользователей, желающих быть в курсе новых направлений, Phemex предлагает удобную и безопасную платформу для отслеживания трендов и поиска возможностей.