Principais Conclusões

IA verificável é a ideia de que saídas de IA, comportamento do modelo ou procedência de conteúdo devem vir acompanhados de evidências, não apenas afirmações.

Na prática, IA verificável pode envolver procedência de conteúdo, marca d’água, assinaturas criptográficas, ambientes de execução confiáveis (TEEs) e outros sistemas de provas, como prova de conhecimento zero ou outros métodos para inferência.

O conceito é especialmente relevante em cripto porque contratos inteligentes não podem depender com segurança de saídas de IA fora da cadeia sem uma camada de verificação que minimize a confiança.

Em abril de 2026, o espaço conta com narrativas de infraestrutura emergentes de projetos como Chainlink, Lagrange e 0G, além de padrões de procedência mais amplos como C2PA Content Credentials e ferramentas de marca d’água como SynthID.

IA verificável é promissora, mas ainda está em estágio inicial. Não há um padrão universal e diferentes sistemas verificam aspectos distintos.

A inteligência artificial está cada vez mais poderosa, porém também se torna mais difícil de confiar. Quando um modelo de IA resume um relatório, sinaliza uma transação, precifica um ativo, executa uma ação on-chain ou gera uma imagem, normalmente os usuários precisam confiar que o sistema fez o que alegou. Na maioria dos casos, não é possível verificar de forma independente qual modelo produziu a saída, quais dados foram usados, se o resultado foi alterado ou se o modelo rodou em um ambiente aprovado. Essa lacuna de confiança é o que a IA verificável busca solucionar. A OpenAI descreve verificabilidade em IA como a capacidade de fornecer evidências para afirmações sobre sistemas de IA, enquanto o NIST destaca técnicas como marca d’água, assinaturas criptográficas, impressões digitais digitais e verificação de integridade de modelos para apoiar a procedência do conteúdo e sistemas de IA confiáveis.

De forma geral, IA verificável se refere a métodos que tornam sistemas de IA mais auditáveis, prováveis e resistentes a manipulações. Dependendo do caso de uso, isso pode significar comprovar a procedência de conteúdo gerado por IA, provar que um modelo específico foi executado conforme declarado, garantir que entradas e saídas não foram alteradas ou assegurar que cálculos de IA off-chain são confiáveis para uma aplicação on-chain. A recente descrição da Chainlink sobre a "pilha de IA verificável" resume bem: combina IA com provas criptográficas e infraestrutura blockchain para que contratos inteligentes possam consumir saídas de IA com garantias de integridade sobre a execução fora da cadeia.

Ou seja, IA verificável não é um produto ou token único. É uma filosofia de design mais ampla: não basta pedir para confiar em um sistema de IA—é preciso fornecer evidências.

O Que Realmente Significa "IA Verificável"?

O termo pode parecer abstrato. Vale simplificar para uma pergunta:

O que exatamente estamos verificando?

Isso pode envolver diferentes aspectos:

Verificação de procedência — Esta imagem, vídeo, áudio ou documento foi criado ou editado por IA? Qual seu histórico? O padrão Content Credentials da C2PA é baseado nessa ideia, propondo uma forma de estabelecer procedência de conteúdo digital e vincular, de maneira segura, declarações sobre como o conteúdo foi criado ou modificado.

Verificação de geração — Este conteúdo foi produzido por um sistema de IA aprovado? O SynthID do Google DeepMind é um exemplo de abordagem de marca d’água para identificar conteúdo gerado ou alterado por IA.

Verificação de execução — O modelo de IA realmente rodou conforme declarado, com as entradas previstas, no ambiente previsto e sem manipulação? Aqui entram TEEs, sistemas de atestação e sistemas de inferência baseados em provas. O material educativo da Chainlink e sua análise recente sobre IA verificável conectam esse problema diretamente à execução segura de modelos e computação confiável.

Verificação de cálculo para blockchains — Um contrato inteligente pode agir com segurança sobre uma saída de IA se o modelo rodou fora da cadeia? Como blockchains não podem inspecionar inferências off-chain, camadas de computação e provas verificáveis se tornam essenciais para que ações de IA possam desencadear eventos on-chain de alto valor.

Assim, ao mencionar "IA verificável", pode-se estar se referindo a uma ou várias dessas camadas. Por isso, a categoria é ampla: uma equipe pode focar na autenticação de mídias, outra na verificação de inferência e outra na auditoria de agentes de IA em fluxos on-chain.

Por Que IA Verificável É Importante

A IA é útil justamente porque pode agir onde humanos não conseguem checar tudo manualmente. Mas isso cria um problema: quanto mais importante o resultado, maior a necessidade de verificação.

Exemplos:

- Um modelo de IA sinaliza transações suspeitas para uma plataforma financeira regulada.

- Um oráculo de IA fornece análise de eventos para um mercado de previsões.

- Um agente de IA autônomo rebalanceia uma carteira on-chain.

- Uma imagem ou vídeo gerado viraliza durante um evento relevante para o mercado.

- Uma empresa quer provas de que um modelo seguiu restrições de uso de dados ou conformidade.

Em todos esses casos, a confiança não pode depender apenas da "palavra do modelo". As recomendações do NIST para redução de risco de conteúdo sintético destacam marca d’água e autenticação de conteúdo como ferramentas para procedência e integridade, enquanto as práticas da OpenAI em verificabilidade visam fornecer evidências de que sistemas de IA são seguros, justos e preservam a privacidade.

No contexto cripto, o desafio é ainda maior. Blockchains são projetadas para minimizar a confiança, enquanto sistemas de IA costumam ser opacos, off-chain e difíceis de auditar. Isso cria um descompasso. Materiais recentes da Chainlink reforçam: são necessárias IA verificável e orquestração de agentes para que processos e fluxos baseados em modelos off-chain possam ser reportados on-chain com transparência, auditabilidade e conformidade.

Por isso, IA verificável se tornou um dos tópicos mais relevantes na interseção entre IA e cripto. Ela busca unir sistemas inteligentes a infraestruturas que minimizam a necessidade de confiança.

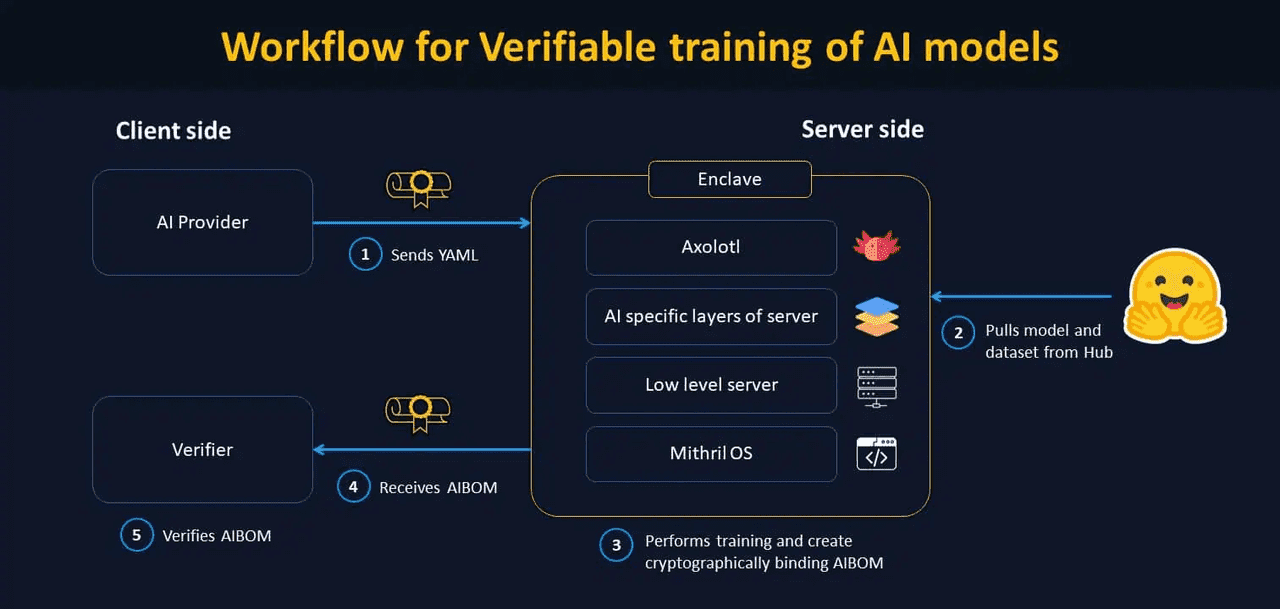

Fluxo Verificável para Treinamento de IA (fonte)

Os Principais Pilares da IA Verificável

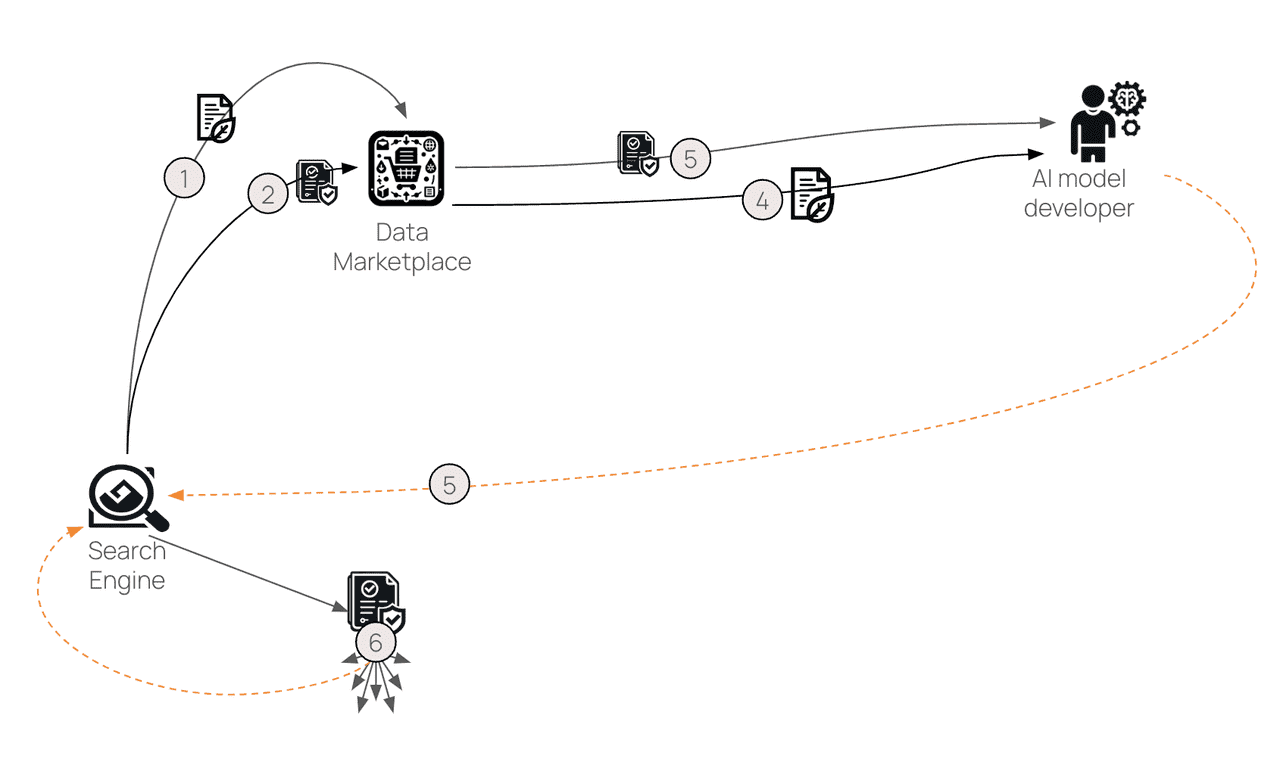

Procedência e Credenciais de Conteúdo

Uma das formas mais simples de IA verificável é provar a origem do conteúdo.

O framework C2PA é um dos padrões líderes. Segundo sua documentação, Content Credentials são uma forma de estabelecer procedência e vincular essas informações ao conteúdo, funcionando como um “rótulo nutricional” digital que permite inspecionar seu histórico.

Isso não garante que o conteúdo seja "verdadeiro", mas ajuda a responder perguntas como:

- Quem criou?

- Houve envolvimento de IA?

- Foi editado?

- Qual software participou?

- Os dados de procedência foram preservados?

Esse tipo de informação é importante para jornalismo, marcas, provas legais ou qualquer contexto onde a manipulação midiática possa causar danos. No universo cripto, isso também importa, pois capturas de tela falsas, documentos falsos e desinformação gerada por IA podem influenciar mercados rapidamente.

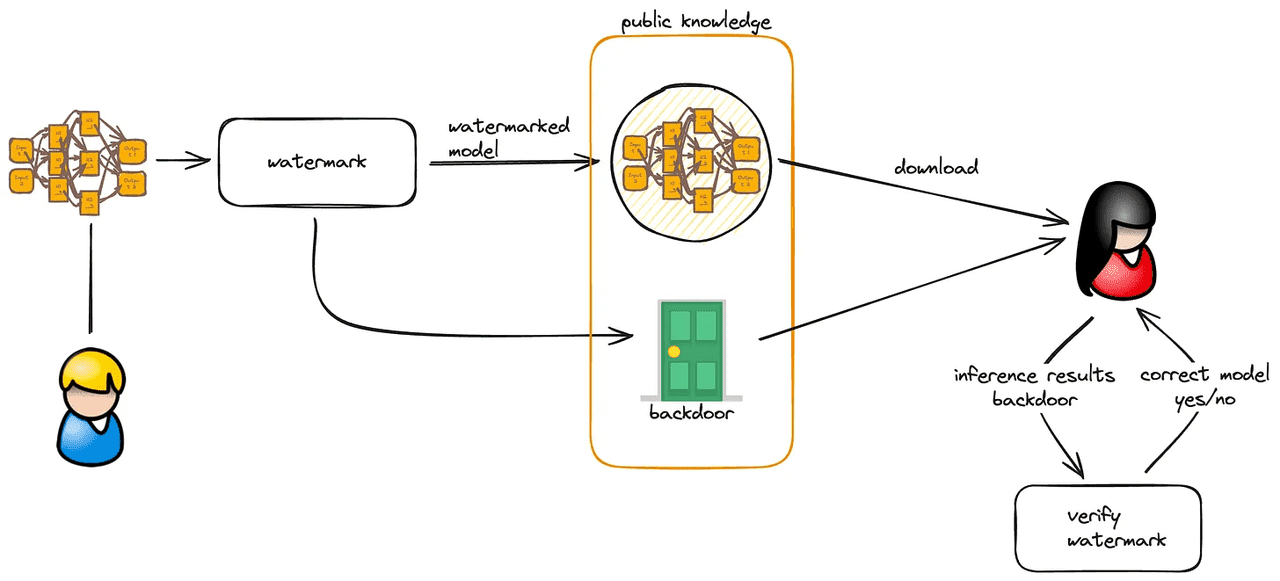

Marca d’Água

Outro pilar é a marca d’água: inserir sinais em mídias geradas por IA para posterior identificação.

O SynthID do Google DeepMind é um exemplo claro. O sistema embute marca d’água imperceptível nos pixels de imagens geradas, e há também abordagens para áudio. Isso visa aumentar a transparência e confiança na IA generativa.

Marcas d’água são úteis, mas não solução completa. O NIST sugere que procedência e marca d’água ajudam na autenticação, porém precisam ser avaliadas quanto à confiabilidade e resistência à manipulação ou remoção.

Portanto, marcas d’água são apenas uma faceta da IA verificável.

Ambientes de Execução Confiáveis (TEEs)

Outra abordagem é verificar onde e como o modelo foi executado.

TEEs são ambientes isolados por hardware que comprovam que o cálculo ocorreu em um sistema protegido. A explicação da Chainlink sobre TEEs no contexto de blockchain destaca sua relevância, já que pesos de modelos e dados podem ser sensíveis ou proprietários, e TEEs protegem a confidencialidade ao mesmo tempo que permitem IA verificável.

Isso é fundamental em redes de computação descentralizada. Ao terceirizar inferência, desenvolvedores precisam confiar que a máquina rodou o modelo correto, preservou a privacidade e não forjou os resultados. TEEs fornecem atestação do ambiente de execução—embora não sejam solução perfeita.

Provas Criptográficas de Inferência

Uma abordagem mais robusta, porém complexa, é provar o cálculo da IA.

Aqui entram aprendizado de máquina com provas de conhecimento zero, inferência verificável e sistemas baseados em provas. Pesquisas recentes exploram como comprovar treinamento, inferência ou testes sem revelar dados sensíveis. Um artigo de março de 2026 propôs provas criptográficas mais leves para modelos grandes, buscando reduzir o custo computacional.

O objetivo maior da IA verificável é oferecer não só “confie nesta caixa segura”, mas “aqui está a prova criptográfica de que o cálculo ocorreu corretamente”. Na prática, ainda é difícil para modelos grandes, pois as provas são pesadas, mas a direção da pesquisa é tornar a inferência provável e ágil.

Exemplo de Caso de Uso (fonte)

O Que IA Verificável Significa em Cripto

No software tradicional, confiança vem de reputação, contratos e supervisão centralizada. Em cripto, o padrão é diferente: usuários esperam sistemas abertos, composáveis e auditáveis.

Isso gera tensão. A IA é cada vez mais útil para negociação, automação, compliance e previsão, mas saídas de modelos opacos são difíceis de alinhar com infraestrutura descentralizada. Artigos recentes da Chainlink destacam que oráculos descentralizados, reportes com consenso e computação verificável podem ocupar esse papel, possibilitando o processamento e agregação de dados em infraestrutura distribuída e reportando on-chain com menos dependência de operadores individuais.

Isso é relevante para:

- Oráculos de IA para mercados de previsão, seguros ou protocolos baseados em eventos

- Agentes de negociação autônomos que precisam de dados confiáveis e ações auditáveis

- Fluxos de compliance onde instituições precisam de provas de aplicação de políticas

- Apps on-chain que querem usar IA sem centralizar confiança

Resumindo, IA verificável torna o conceito de “IA em blockchain” algo concreto e tangível.

Exemplos de Narrativas de IA Verificável no Mercado

Chainlink: A Pilha de IA Verificável

Chainlink é uma das principais vozes ao estruturar IA verificável como uma pilha que combina IA, provas criptográficas e infraestrutura blockchain. Seus materiais recentes conectam o tema a contratos inteligentes, TEEs, orquestração de agentes, contratos institucionais e computação off-chain verificável.

O ponto central é: não se trata apenas de “Chainlink faz IA”, mas de estruturar um framework sobre como saídas de IA podem ser confiáveis o suficiente para uso on-chain.

Lagrange: IA Verificável com ZK

A documentação do Lagrange posiciona o projeto em torno de tecnologia verificável e afirma que seu produto DeepProve é voltado para IA verificável. O projeto acredita que sistemas de prova de conhecimento zero (ZK) serão parte fundamental da infraestrutura de cálculo de IA confiável.

0G: Infraestrutura para IA Descentralizada

A documentação do 0G aborda não só verificabilidade, mas também demais aspectos da infraestrutura para IA descentralizada, como inferência, armazenamento e disponibilidade de dados descentralizados. O projeto detalha como desenvolvedores podem acessar serviços de inferência e como a rede lida com disponibilidade e verificação de dados por meio de nós especializados.

Esses exemplos mostram que IA verificável vai além da teoria acadêmica—é uma narrativa viva e cada vez mais implementada no mercado cripto.

Como IA Verificável Pode Funcionar na Prática

Uma boa maneira de enxergar IA verificável é como uma cadeia de evidências.

Por exemplo, imagine um produto de seguro on-chain movido por IA:

- O usuário envia uma reivindicação com imagens e documentos.

- Um modelo analisa a reivindicação off-chain.

- O sistema registra a procedência das mídias submetidas e geradas.

- O modelo é executado em um TEE ou ambiente atestado.

- Uma rede descentralizada verifica as entradas ou agrega as saídas do modelo.

- O resultado é assinado, registrado e reportado on-chain.

- O contrato inteligente só age se todas as evidências forem verificadas.

Diferentes sistemas vão implementar partes distintas dessa pilha, mas a ideia central é: tornar cada etapa crítica mais auditável e resistente a fraudes. Materiais recentes da Chainlink sobre contratos inteligentes institucionais e orquestração de IA alinham-se a essa arquitetura, enquanto sistemas como C2PA e marcas d’água tratam a mídia e a procedência.

O Papel dos Dados na IA Verificável (fonte)

Benefícios da IA Verificável

O maior benefício é óbvio: mais confiança. Mas essa confiança se desdobra em ganhos específicos.

Primeiro, a auditabilidade melhora. Em vez de pedir que usuários confiem somente na declaração do provedor de modelo, sistemas podem fornecer credenciais, assinaturas, atestados ou provas.

Segundo, facilita-se a conformidade regulatória. Materiais recentes da Chainlink sobre IA para compliance mostram por que o setor financeiro se importa: aplicação de políticas, auditoria e trilhas de auditoria ficam mais acessíveis quando a infraestrutura foi projetada para provar o que ocorreu.

Terceiro, aumenta a resiliência contra manipulação. Sistemas de procedência e marcas d’água não impedem todo deepfake ou desinformação, mas tornam alterações mais detectáveis e autenticidade mais robusta.

Quarto, aprimora a composabilidade no Web3. Contratos inteligentes, agentes e protocolos podem usar IA de modo mais seguro quando é possível inspecionar as provas associadas ao resultado.

Limitações e Riscos

IA verificável é promissora, mas não é mágica.

Uma limitação importante é que métodos diferentes verificam aspectos distintos. Uma marca d’água pode indicar que uma mídia foi criada por IA, mas não garante que a informação veiculada é verdadeira. Um histórico de procedência mostra edições, mas não comprova veracidade. Um TEE atesta o ambiente, mas não necessariamente todas as propriedades desejadas. E sistemas de provas para inferência ainda são caros computacionalmente para modelos grandes.

Outro desafio é a fragmentação de padrões. C2PA é relevante para procedência, mas não resolve execução de IA. Sistemas ZK avançam, mas ainda não são camada universal para todas as aplicações. TEEs são práticos, porém trazem premissas de confiança próprias sobre hardware e atestação.

Há ainda o trade-off entre custo e performance. Verificação mais forte implica mais sobrecarga. Por isso, pesquisas buscam sistemas de provas mais leves e abordagens híbridas ao invés de assumir que toda inferência será comprovada com baixo custo. Por fim, existe risco de marketing: projetos podem usar “IA verificável” como narrativa mesmo com garantias limitadas.

Conclusão

IA verificável é um dos conceitos mais importantes surgidos na interseção entre IA e cripto, pois ataca uma fraqueza central dos sistemas de IA modernos: a opacidade.

À medida que a IA se integra a aplicativos financeiros, agentes on-chain, sistemas de mídia e fluxos de compliance, os usuários precisarão de mais que saídas de modelos. Precisarão de provas, procedência, atestados e trilhas de auditoria. Esse é o verdadeiro potencial da IA verificável.

A área ainda é emergente em abril de 2026 e não possui uma arquitetura universal. Desenvolve-se como uma pilha: padrões de procedência como C2PA, ferramentas de marca d’água como SynthID, métodos de execução confiável como TEEs e sistemas de provas mais avançados para inferência e liquidação on-chain. Projetos e provedores como Chainlink, Lagrange e 0G impulsionam diferentes partes deste ecossistema.

O resumo é: IA verificável transforma a IA de algo que você apenas usa em algo que você pode inspecionar e confiar, com evidências. Se essa tendência continuar, pode se tornar uma das bases da próxima geração de aplicações cripto movidas por IA.

Com a convergência entre IA e blockchain, narrativas como IA verificável podem ganhar ainda mais importância para traders e desenvolvedores. Para quem deseja acompanhar tendências emergentes de setores desde agentes de IA e DePIN até RWAs e infraestrutura on-chain, a Phemex oferece uma plataforma segura e intuitiva para monitorar o mercado, explorar novas oportunidades e aprimorar sua experiência de negociação.